Índice del contenido

¿Cómo se integran las herramientas antiplagio en los sistemas de gestión del aprendizaje (LMS)?

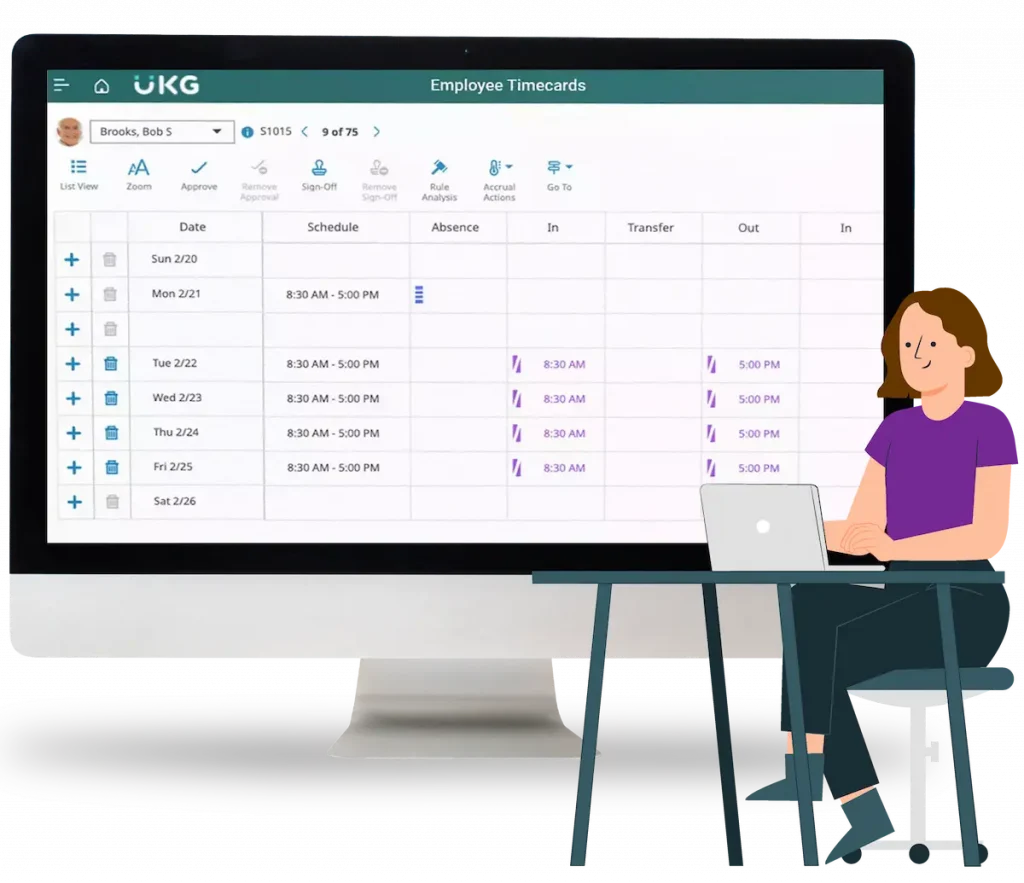

¿Cómo se integran las herramientas antiplagio en los sistemas de gestión del aprendizaje (LMS)? En el ecosistema educativo digital actual, la integración de herramientas antiplagio en los sistemas de gestión del aprendizaje (LMS) ha dejado de ser un complemento opcional para convertirse en un componente esencial de la calidad académica, la transparencia institucional y la ética educativa. En un entorno donde los contenidos se comparten, se reutilizan y se transforman con facilidad, garantizar la originalidad del trabajo intelectual es una responsabilidad estratégica tanto para los docentes como para los directivos. La combinación de LMS y software antiplagio no solo fortalece la integridad del proceso formativo, sino que también optimiza la gestión administrativa y reduce riesgos reputacionales para las instituciones educativas y corporativas. 1. La nueva arquitectura del aprendizaje digital Los sistemas de gestión del aprendizaje (LMS), como Moodle, Canvas, Blackboard o Google Classroom, funcionan como el eje central de la educación digital moderna. Permiten crear, distribuir, evaluar y almacenar contenido educativo de manera estructurada. Sin embargo, la masificación de los entornos virtuales de aprendizaje también ha traído un desafío creciente: el incremento de contenidos no originales o copiados. Aquí es donde entran en juego las herramientas antiplagio, integrándose dentro del LMS para crear un ecosistema de aprendizaje seguro, ético y verificable. Estas integraciones se realizan a través de APIs (Application Programming Interfaces) o LTI (Learning Tools Interoperability), protocolos que permiten que las plataformas se comuniquen entre sí de forma fluida. Gracias a esta interoperabilidad, los docentes pueden verificar la originalidad de los trabajos sin salir del entorno LMS, y los estudiantes reciben retroalimentación automática sobre sus niveles de similitud antes de enviar sus entregas finales. 2. Flujo operativo de la integración El proceso de integración entre una herramienta antiplagio y un LMS sigue una estructura técnica bien definida. Cuando un estudiante sube un archivo —ensayo, informe o proyecto— dentro del curso en línea, el LMS lo envía automáticamente al motor de análisis de la herramienta antiplagio. El sistema compara el texto con bases de datos locales, publicaciones científicas, repositorios institucionales y contenido web global. Posteriormente, devuelve un reporte de similitud que indica el porcentaje de coincidencias y muestra los fragmentos sospechosos de ser copiados. Todo este proceso ocurre en cuestión de segundos, sin necesidad de que el usuario abandone la interfaz del LMS. El docente recibe un informe visual con códigos de color que destacan las secciones coincidentes, mientras que el estudiante, dependiendo de la configuración institucional, puede revisar su propio reporte para mejorar su trabajo antes de la entrega final. Este enfoque formativo y preventivo es una de las grandes ventajas de la integración. 3. Beneficios estratégicos para las instituciones Para las instituciones educativas, la integración de herramientas antiplagio en los LMS representa una ventaja competitiva y de reputación. Garantiza que los trabajos evaluados sean auténticos, promueve la ética académica y refuerza la confianza entre estudiantes, docentes y padres. Además, desde una perspectiva de gestión, esta integración reduce significativamente la carga administrativa, al automatizar los procesos de revisión de originalidad. Los reportes generados pueden almacenarse como evidencia documental, lo que facilita auditorías académicas, procesos de acreditación y cumplimiento normativo con estándares internacionales de calidad educativa. Otra ventaja clave es la posibilidad de analizar tendencias institucionales. Los departamentos académicos pueden monitorear qué cursos o programas presentan más incidencias de similitud, y diseñar estrategias de formación ética o metodológica adaptadas a esas áreas críticas. En otras palabras, el sistema no solo detecta el plagio: enseña a prevenirlo. 4. Perspectiva del estudiante: aprendizaje ético y retroalimentación inmediata Desde el punto de vista del estudiante, la integración de herramientas antiplagio dentro del LMS transforma la percepción de la evaluación. Ya no se trata de un mecanismo punitivo, sino de una oportunidad de aprendizaje. Cuando el estudiante puede acceder a su propio informe de similitud, tiene la posibilidad de identificar errores de citación, mejorar sus habilidades de escritura y comprender la importancia del pensamiento original. Este enfoque fomenta la autorregulación y la responsabilidad académica, dos competencias esenciales en la educación moderna. Además, la inmediatez del feedback motiva al estudiante a revisar y perfeccionar sus trabajos, elevando así la calidad general de los productos académicos. 5. Rol del docente: de vigilante a mentor La integración entre LMS y herramientas antiplagio también redefine el rol del docente. En lugar de invertir tiempo en detectar manualmente posibles casos de copia, puede centrarse en orientar a sus alumnos hacia prácticas más éticas y metodológicamente correctas. La automatización de la detección libera tiempo para la enseñanza, mientras que los reportes detallados facilitan la conversación pedagógica sobre la autoría, la creatividad y el uso responsable de la información. Así, el docente deja de ser un fiscal del plagio para convertirse en un mentor de integridad académica. 6. Integración técnica y seguridad de datos Uno de los factores críticos en esta integración es la seguridad y privacidad de los datos. Los sistemas antiplagio deben cumplir con normativas internacionales como el GDPR (Reglamento General de Protección de Datos) en Europa o las Leyes de Protección de Datos Personales en América Latina. Cuando se integran con un LMS, las instituciones deben garantizar que los documentos analizados no se utilicen fuera del propósito educativo, y que los repositorios donde se almacenan estén encriptados y gestionados de forma ética. Las soluciones líderes del mercado, como Turnitin, Urkund o Grammarly Business, implementan sistemas de anonimización y protocolos de seguridad certificados para garantizar la confidencialidad de la información. De este modo, la confianza institucional no solo depende de la precisión del software, sino también de su transparencia y compromiso ético con los usuarios. 7. Innovación y personalización Los LMS modernos permiten personalizar la integración con las herramientas antiplagio según las políticas institucionales. Por ejemplo, una universidad puede configurar la herramienta para que los reportes sean visibles solo para los docentes, mientras que otra puede permitir que los estudiantes los vean antes de enviar su versión final. También es posible ajustar el umbral de similitud (por ejemplo, 20%, 30%, etc.) o excluir bibliografías, citas cortas o trabajos previos del mismo autor. Esta flexibilidad convierte a IRMA Digital y otras plataformas similares en ecosistemas adaptables, capaces de responder a las necesidades éticas y pedagógicas de cada organización. A largo plazo, estas configuraciones fortalecen la cultura institucional de integridad académica y reducen significativamente los casos de fraude o malas prácticas. 8. Perspectiva gerencial: toma de decisiones basada en datos Desde la óptica de los directores académicos y gerentes tecnológicos, la integración entre LMS y herramientas antiplagio ofrece un valor estratégico incalculable. Los reportes agregados permiten visualizar indicadores de integridad institucional, tasas de recurrencia y evolución en el comportamiento académico de los estudiantes. Estos datos alimentan los procesos de inteligencia institucional, ayudando a los líderes a diseñar políticas, capacitaciones y campañas de concienciación basadas en evidencia. Además, al centralizar la información en el LMS, se facilita la interoperabilidad con otros módulos de gestión (recursos humanos, calidad, acreditación), potenciando la eficiencia global del sistema educativo. 9. El futuro de la integración: detección de IA generativa Una tendencia emergente es la capacidad de las herramientas antiplagio integradas en LMS para detectar contenidos generados por inteligencia artificial, como textos creados con ChatGPT, Claude o Gemini. Las soluciones más avanzadas ya incorporan algoritmos de detección de patrones de lenguaje y metadatos sintéticos que distinguen entre escritura humana y artificial. Esta evolución marcará una nueva etapa en la defensa de la autenticidad intelectual dentro de los entornos virtuales. 10. Conclusión: integridad digital como eje institucional En síntesis, la integración de herramientas antiplagio en los sistemas de gestión del aprendizaje (LMS) no es una opción tecnológica, sino una necesidad institucional. Permite garantizar la calidad académica, promover la ética digital, proteger la propiedad intelectual y consolidar la confianza en el aprendizaje en línea. Para los líderes educativos, representa una oportunidad de transformar el control en cultura, la vigilancia en aprendizaje y la tecnología en un instrumento de desarrollo humano sostenible. El futuro de la educación digital no se medirá solo por el acceso a la información, sino por la capacidad de cada institución para proteger la originalidad y el pensamiento crítico en la era de la inteligencia artificial.

¿Qué ventajas ofrece el uso de inteligencia artificial en las herramientas antiplagio de última generación?

¿Qué ventajas ofrece el uso de inteligencia artificial en las herramientas antiplagio de última generación? En el contexto actual, donde la creación de contenidos digitales se ha multiplicado exponencialmente y las fronteras entre lo original y lo replicado se vuelven cada vez más difusas, la inteligencia artificial (IA) se ha convertido en el motor que impulsa la evolución de las herramientas antiplagio de última generación. Estas herramientas ya no se limitan a comparar textos o detectar coincidencias literales: hoy son sistemas inteligentes, predictivos y contextuales capaces de entender el significado, la intención y la estructura del contenido. La IA ha transformado el paradigma de la detección de plagio, llevando el proceso de la mera comparación textual hacia una comprensión semántica y cognitiva del lenguaje. 1. De la detección superficial al análisis profundo Las herramientas antiplagio tradicionales basaban su funcionamiento en la detección de coincidencias exactas. Comparaban fragmentos de texto con bases de datos y fuentes en línea, identificando similitudes por repetición literal. Este enfoque, aunque útil, resultaba limitado frente a plagios disimulados, parafraseos o traducciones manipuladas. La inteligencia artificial ha revolucionado este escenario. Mediante técnicas de procesamiento de lenguaje natural (NLP), las nuevas herramientas comprenden el contexto, analizan la estructura sintáctica y semántica de las oraciones y detectan similitudes conceptuales, incluso cuando el texto ha sido reescrito con sinónimos o con otro orden gramatical. Esto permite una detección más profunda, precisa y justa, capaz de distinguir entre coincidencias legítimas (por ejemplo, citas o expresiones comunes) y verdaderas apropiaciones indebidas del contenido. 2. Aprendizaje automático: el sistema que mejora con cada revisión La inteligencia artificial dota a las herramientas antiplagio de una característica extraordinaria: el aprendizaje continuo. A través del machine learning, los algoritmos analizan miles de documentos, reportes y correcciones para perfeccionar sus criterios de detección. Cada vez que una herramienta identifica o descarta un caso de plagio, “aprende” del resultado y ajusta sus patrones para aumentar su precisión futura. Esto convierte a las herramientas modernas en sistemas evolutivos, capaces de adaptarse a las nuevas formas de plagio y escritura que surgen constantemente. Por ejemplo, pueden aprender a detectar estilos específicos de parafraseo automatizado, traducciones encubiertas o incluso textos generados parcialmente por inteligencia artificial. El resultado es una herramienta que no solo detecta, sino que anticipa y previene. 3. Análisis semántico y detección del sentido Una de las grandes ventajas del uso de IA en las herramientas antiplagio es su capacidad para entender el significado detrás del texto. A través de modelos lingüísticos como BERT (Bidirectional Encoder Representations from Transformers) o GPT (Generative Pre-trained Transformer), el sistema analiza no solo las palabras, sino las relaciones entre ellas, el tono del texto y el flujo lógico de las ideas. Esto significa que la IA puede reconocer cuando dos textos expresan el mismo contenido con diferentes palabras, algo que los sistemas tradicionales no podían detectar con precisión. Por ejemplo, si un estudiante reescribe un párrafo cambiando el orden de las oraciones o sustituyendo términos por sinónimos, la herramienta basada en IA puede identificar la equivalencia conceptual y marcar el posible plagio con un nivel de certeza mucho mayor. De esta manera, el análisis semántico permite pasar de la coincidencia textual a la coincidencia de ideas, fortaleciendo la integridad académica y científica. 4. Detección de textos generados por inteligencia artificial Una de las funciones más innovadoras de las herramientas antiplagio de última generación es su capacidad para detectar textos creados por IA generativa, como ChatGPT, Gemini o Claude. Estas herramientas utilizan modelos de detección basados en el análisis de patrones lingüísticos, coherencia estructural y probabilidades de generación sintética. Los algoritmos comparan la “huella lingüística” de un texto humano (variabilidad, errores, estilo) con la de un texto generado por IA (coherencia perfecta, patrones de repetición, neutralidad estilística). Esta función es cada vez más relevante, ya que el auge de la escritura asistida por IA ha elevado el riesgo de que los usuarios presenten contenido no original, aunque no sea un plagio directo de otra fuente. La IA, por tanto, se convierte en el antídoto de sí misma, utilizando su poder para mantener la autenticidad intelectual en la era de la automatización. 5. Mayor precisión y reducción de falsos positivos Otro beneficio crucial es la reducción de falsos positivos. Los sistemas antiguos solían marcar coincidencias irrelevantes, como citas bibliográficas, términos técnicos o fragmentos comunes, generando confusión en los usuarios. Las herramientas impulsadas por IA son capaces de distinguir entre coincidencias intencionales y coincidencias inevitables. Gracias a los modelos de contexto, los sistemas pueden excluir automáticamente los elementos que forman parte del lenguaje académico estándar, las referencias correctamente citadas o los títulos genéricos. Esto no solo mejora la experiencia del usuario, sino que aumenta la credibilidad de los reportes, evitando interpretaciones erróneas o sanciones injustas. 6. Personalización inteligente y adaptabilidad institucional La IA también permite la personalización adaptativa de las herramientas antiplagio. Cada institución puede configurar los parámetros de detección según su cultura académica, su política de originalidad o el tipo de documentos que evalúa. Por ejemplo, un centro de investigación puede requerir mayor sensibilidad en los textos científicos, mientras que una escuela puede priorizar la formación ética más que la sanción. Las herramientas impulsadas por IA pueden ajustar sus modelos de detección y retroalimentación de forma progresiva, aprendiendo de los patrones internos de la institución. Esto crea un entorno de análisis coherente con las necesidades y valores de cada organización, un paso clave hacia la gestión personalizada de la integridad académica. 7. Retroalimentación automatizada y aprendizaje formativo La inteligencia artificial no solo detecta, sino que enseña. Las herramientas más avanzadas ofrecen retroalimentación automática a los estudiantes, señalando errores de citación, explicando por qué un fragmento podría considerarse no original y recomendando cómo corregirlo. De este modo, el sistema deja de ser un instrumento de control para convertirse en un mentor digital, ayudando a los usuarios a comprender las normas de escritura académica y fortalecer su pensamiento crítico. Esta orientación personalizada contribuye al desarrollo de una cultura ética del conocimiento, especialmente valiosa en entornos educativos donde la formación en integridad es tan importante como el contenido mismo. 8. Analítica de integridad y apoyo a la gestión institucional Desde una perspectiva gerencial, las herramientas antiplagio con IA proporcionan analítica avanzada que ayuda a los directores académicos y líderes tecnológicos a tomar decisiones estratégicas. Los reportes institucionales permiten identificar patrones de recurrencia, detectar áreas de riesgo, evaluar la efectividad de las políticas de integridad y medir la evolución de la ética académica a lo largo del tiempo. Esta inteligencia de datos convierte a las herramientas antiplagio en aliadas de la planificación estratégica, brindando información valiosa para mejorar currículos, capacitar al personal docente y fortalecer la reputación institucional. 9. Escalabilidad y velocidad de procesamiento Las herramientas antiplagio impulsadas por IA son capaces de procesar millones de documentos simultáneamente, gracias a la automatización en la nube y los algoritmos de búsqueda paralela. Esto las hace ideales para universidades, editoriales y organizaciones que manejan grandes volúmenes de información. El tiempo de análisis, que antes tomaba minutos o incluso horas, se ha reducido a segundos, sin comprometer la calidad de la revisión. Además, su infraestructura escalable permite ampliar la capacidad de análisis a medida que crece la institución, sin necesidad de nuevas inversiones en hardware o software local. 10. Ética, transparencia y confiabilidad Finalmente, la aplicación de inteligencia artificial en las herramientas antiplagio también plantea una nueva dimensión ética. Las instituciones que adoptan estos sistemas deben asegurar que los algoritmos operen con transparencia, sin sesgos y respetando la privacidad de los datos. Los proveedores líderes ya trabajan bajo principios de IA ética, garantizando que la detección se utilice para educar y no para castigar. El equilibrio entre automatización y humanidad será la clave del futuro: la tecnología aporta precisión, pero la ética da legitimidad. Las instituciones que comprendan esta dualidad serán las que realmente lideren la transformación digital del aprendizaje. Conclusión El uso de inteligencia artificial en las herramientas antiplagio de última generación ha redefinido por completo la integridad académica y profesional. Estas soluciones combinan velocidad, precisión y comprensión contextual para garantizar que la originalidad del pensamiento siga siendo el valor supremo en la educación y la investigación. Lejos de ser un sistema de vigilancia, la IA convierte la detección del plagio en una experiencia educativa, fomentando la honestidad, el aprendizaje autónomo y la cultura de la autenticidad. El futuro del conocimiento dependerá de nuestra capacidad para utilizar la inteligencia artificial no solo como detectora de errores, sino como catalizadora de valores.

¿Cómo pueden los líderes educativos integrar las herramientas antiplagio dentro de políticas institucionales de integridad académica?

¿Cómo pueden los líderes educativos integrar las herramientas antiplagio dentro de políticas institucionales de integridad académica? La integridad académica es el cimiento ético sobre el que se construye toda institución educativa. En un mundo donde la información fluye sin límites y las tecnologías permiten crear, copiar y transformar contenido en segundos, preservar la autenticidad del conocimiento se ha convertido en una prioridad estratégica. En este contexto, las herramientas antiplagio no son simples recursos tecnológicos, sino pilares fundamentales en la construcción de políticas institucionales de integridad académica. Sin embargo, su éxito no depende únicamente de su adquisición, sino del liderazgo con que son implementadas, gestionadas y sostenidas dentro del ecosistema educativo. 1. El liderazgo ético como punto de partida La integración efectiva de herramientas antiplagio comienza con una visión clara del liderazgo educativo. Los directores, rectores y gerentes académicos deben asumir el compromiso de promover una cultura de integridad que vaya más allá del cumplimiento normativo. Esto implica comprender que la tecnología es un medio, no un fin: una herramienta poderosa para educar en valores, prevenir malas prácticas y fortalecer la credibilidad institucional. El líder ético es aquel que comunica la importancia de la honestidad intelectual, no desde la sanción, sino desde la construcción de confianza y responsabilidad colectiva. Bajo esta premisa, las herramientas antiplagio deben presentarse como aliadas del aprendizaje, no como mecanismos de vigilancia. 2. Diagnóstico institucional: entender la cultura antes de digitalizarla Antes de implementar cualquier sistema antiplagio, los líderes deben realizar un diagnóstico de la cultura institucional. No todas las organizaciones se encuentran en el mismo nivel de madurez digital o ética. Algunas poseen estructuras sólidas de autorregulación, mientras que otras necesitan desarrollar sensibilización y capacitación en temas de integridad. Este diagnóstico debe incluir: La evaluación del conocimiento docente y estudiantil sobre derechos de autor y citación. El análisis de las prácticas de escritura académica. La revisión de políticas previas relacionadas con la originalidad y la honestidad intelectual. Con base en estos hallazgos, se pueden diseñar estrategias de implementación gradual, adaptadas al contexto y nivel de preparación de la comunidad. 3. Creación de una política institucional integral Integrar herramientas antiplagio dentro de las políticas institucionales de integridad académica requiere una estructura formal, clara y participativa. Esta política debe ser un documento vivo que establezca objetivos, principios, responsabilidades y procedimientos. Los líderes deben incluir en ella aspectos como: Definición de qué se considera plagio y qué no. Herramientas tecnológicas autorizadas y sus criterios de uso. Derechos y deberes de docentes, estudiantes y personal administrativo. Procedimientos de evaluación, corrección y sanción. Protocolos de confidencialidad y protección de datos. Una política institucional bien diseñada no solo regula, sino que educa y orienta. Se convierte en una guía para toda la comunidad académica y en un compromiso público con la transparencia y la excelencia. 4. Formación y acompañamiento continuo Ninguna herramienta antiplagio tendrá éxito si los usuarios no comprenden su propósito. Por ello, los líderes deben impulsar programas de formación continua que enseñen no solo a usar el software, sino a entender la ética del conocimiento. Estas capacitaciones deben abordar temas como: Citación y referenciación correcta. Parafraseo ético y escritura académica. Uso responsable de la inteligencia artificial en la producción de textos. Interpretación de reportes de similitud y cómo mejorarlos. Además, se recomienda incluir módulos prácticos dentro de los cursos regulares, donde los estudiantes puedan experimentar con las herramientas y recibir retroalimentación formativa antes de la entrega final. De este modo, la detección se transforma en aprendizaje, y la política se vuelve práctica. 5. Comunicación clara y enfoque preventivo El éxito de la integración depende de la forma en que se comunica. Las herramientas antiplagio deben presentarse como instrumentos de acompañamiento y mejora, no como mecanismos de persecución. Cuando los estudiantes entienden que el objetivo es ayudarlos a crecer y no sancionarlos, la aceptación aumenta y la resistencia disminuye. Los líderes educativos deben implementar campañas de sensibilización internas, con mensajes positivos y ejemplos de buenas prácticas. El discurso institucional debe centrarse en la autoría responsable, la transparencia y la autenticidad, promoviendo una cultura preventiva más que punitiva. 6. Vinculación con los sistemas de gestión académica Una política moderna de integridad no puede funcionar de manera aislada. Por ello, los líderes deben asegurar que las herramientas antiplagio estén integradas en el sistema de gestión del aprendizaje (LMS) y otros módulos administrativos, como evaluación docente, acreditación o investigación. Esto garantiza la trazabilidad de los reportes, la generación automática de estadísticas y la disponibilidad de información para auditorías o procesos de calidad. La tecnología, bien implementada, se convierte en un soporte confiable para la gobernanza académica. 7. Analítica institucional y toma de decisiones basada en datos Uno de los mayores beneficios de integrar herramientas antiplagio dentro de una política de integridad es la posibilidad de generar inteligencia institucional. Los reportes de similitud, cuando se analizan de manera agregada, ofrecen datos valiosos sobre tendencias, áreas de riesgo y evolución del comportamiento académico. Por ejemplo, los líderes pueden identificar: Facultades o programas con mayores índices de coincidencia. Tipos de tareas más vulnerables al plagio. Periodos académicos donde aumentan las incidencias. Con estos datos, se pueden diseñar estrategias de mejora continua, focalizando esfuerzos de capacitación o revisión curricular. Así, la política deja de ser un documento normativo para convertirse en una herramienta dinámica de gestión educativa. 8. Ética, transparencia y confianza Toda política de integridad académica debe sustentarse en valores éticos y de respeto. Los líderes deben garantizar que el uso de herramientas antiplagio cumpla con normas de privacidad y confidencialidad, evitando exponer a los estudiantes a juicios injustos o prácticas invasivas. El equilibrio entre tecnología y humanidad es clave. La transparencia en el uso del software —explicando cómo se analizan los textos, qué bases de datos se consultan y cómo se interpretan los resultados— es fundamental para generar confianza. Una institución ética no solo detecta plagio: enseña a no cometerlo. 9. Liderazgo participativo y co-creación de la cultura La verdadera integración no proviene de decretos, sino de la co-creación. Los líderes deben involucrar a docentes, estudiantes, investigadores y personal administrativo en el diseño y revisión de las políticas de integridad. Esta participación fomenta el sentido de pertenencia y compromiso colectivo. Además, permite que la política evolucione con las necesidades reales de la comunidad, evitando la rigidez y asegurando su pertinencia en el tiempo. El liderazgo participativo transforma una herramienta tecnológica en un proyecto institucional compartido. 10. Evaluación, mejora y sostenibilidad Finalmente, toda política institucional debe incluir un sistema de evaluación periódica. Las tecnologías cambian, los contextos se transforman y las prácticas académicas evolucionan; por tanto, las políticas deben adaptarse. Los líderes deben establecer indicadores claros de éxito, como reducción de incidencias, aumento en la calidad de los trabajos o mejora en la percepción de integridad. El seguimiento constante y la actualización tecnológica garantizarán que la política no se convierta en un documento estático, sino en un proceso de mejora continua. Conclusión: del control a la cultura Integrar herramientas antiplagio dentro de políticas institucionales de integridad académica no es solo una cuestión de control o cumplimiento, sino una apuesta por la cultura. Requiere liderazgo ético, visión estratégica y sensibilidad humana. Cuando las instituciones logran alinear tecnología, valores y educación, transforman la integridad en un hábito colectivo, no en una obligación. En ese punto, las herramientas antiplagio dejan de ser simples detectores para convertirse en guardianes del pensamiento original, fortaleciendo la credibilidad institucional y formando ciudadanos comprometidos con la verdad. La educación del futuro no se definirá por el acceso al conocimiento, sino por la capacidad de mantenerlo íntegro, auténtico y humano.

¿Qué retos plantea el uso de IA generativa para las herramientas antiplagio tradicionales?

¿Qué retos plantea el uso de IA generativa para las herramientas antiplagio tradicionales? La irrupción de la inteligencia artificial generativa (IA generativa) —capaz de producir textos, imágenes, código o incluso investigaciones completas— ha transformado radicalmente la naturaleza de la creación de contenido. Herramientas como ChatGPT, Claude, Gemini o Copilot han democratizado la escritura automatizada y han puesto a disposición del usuario común una capacidad de producción textual sin precedentes. Sin embargo, esta revolución también ha desafiado los cimientos sobre los cuales operaban las herramientas antiplagio tradicionales, diseñadas para comparar, no para comprender. Los sistemas de detección clásicos, basados en coincidencias literales y análisis superficiales, se enfrentan ahora a un nuevo enemigo invisible: el texto original sintético. Un texto creado por IA puede ser completamente inédito, coherente, fluido y sin rastro de copia directa; y sin embargo, no ser producto del pensamiento humano. Este fenómeno ha cambiado el juego por completo, obligando a las instituciones, desarrolladores y líderes educativos a repensar la forma en que se define y se mide la autenticidad intelectual. 1. El cambio de paradigma: del plagio textual al plagio conceptual Históricamente, las herramientas antiplagio se centraban en detectar coincidencias textuales. El plagio se entendía como la reproducción literal o ligeramente modificada de contenido ajeno. Pero la IA generativa introduce un nuevo tipo de plagio: el plagio conceptual o asistido, donde el texto no copia, sino que reproduce ideas o estructuras discursivas con una precisión tan alta que simula autoría genuina. Esto representa un cambio filosófico y técnico. El plagio ya no se limita a la reproducción visible de información, sino que puede manifestarse en la apropiación invisible del pensamiento estructurado. Las herramientas tradicionales no fueron diseñadas para detectar esa sutileza, por lo que su eficacia se ve comprometida frente a la inteligencia generativa. 2. La invisibilidad del origen: un desafío para los algoritmos de comparación Las herramientas antiplagio convencionales funcionan mediante la comparación de textos con bases de datos y repositorios digitales. Su principio es simple: “si dos textos se parecen demasiado, hay plagio.” Pero los textos generados por IA no existen previamente en ninguna base de datos; son completamente nuevos. Esto significa que los sistemas tradicionales no encuentran coincidencias y, por tanto, no los detectan como plagio. La IA puede crear un ensayo, artículo o tesis con una estructura académica impecable y sin repetir una sola línea de un documento existente. El problema ya no es la copia, sino la autoría simulada. 3. La trampa de la originalidad sintética El texto generado por IA es “original” en el sentido técnico, pero no en el ético. Las herramientas antiplagio pueden reportar un 0% de similitud en un trabajo completamente escrito por una máquina. Esto crea una paradoja peligrosa: el sistema valida lo que en esencia es una falta de autoría humana. Para las instituciones educativas, este dilema es profundo. ¿Cómo definir la originalidad en una era donde la máquina puede producir contenido único, pero no necesariamente auténtico? El reto no está solo en detectar, sino en redefinir los criterios de integridad académica. 4. Limitaciones técnicas de las herramientas tradicionales Las herramientas antiplagio clásicas —como Turnitin, Plagscan o Urkund en sus primeras versiones— se basan en algoritmos de búsqueda de patrones textuales. Su eficacia radica en su capacidad de comparación, no en su comprensión. Por tanto, cuando se enfrentan a textos generados por IA, no tienen un punto de referencia contra el cual comparar. Además, las estructuras de escritura de la IA son lingüísticamente coherentes pero estilísticamente neutras, lo que dificulta su detección mediante análisis de estilo o gramática. El lenguaje artificial no deja huellas evidentes; su perfección es precisamente su máscara. 5. El surgimiento de nuevas estrategias de detección Ante este desafío, los desarrolladores de herramientas antiplagio están creando una nueva generación de sistemas híbridos, que combinan detección de similitud y detección de artificialidad. Estos nuevos modelos analizan patrones como: La probabilidad estadística de aparición de palabras (perplejidad lingüística). La uniformidad gramatical excesiva. La ausencia de errores típicos humanos. La densidad semántica constante. La estructura excesivamente lógica y equilibrada. Estas métricas permiten estimar la probabilidad de que un texto haya sido generado por IA, incluso si no existe copia textual. Así, las herramientas del futuro no solo compararán, sino que diagnosticarán. 6. Dilemas éticos y académicos emergentes El uso de IA generativa plantea un nuevo conjunto de dilemas éticos. ¿Es plagio utilizar IA para redactar un trabajo si el contenido no copia a nadie? ¿Debe sancionarse a un estudiante que “asista” su escritura con IA del mismo modo que a quien copia? Estas preguntas exigen una revisión ética profunda de las políticas académicas y de los códigos de integridad. Las instituciones deben distinguir entre el uso legítimo de IA como herramienta de apoyo (para corregir, resumir o inspirar ideas) y el uso deshonesto que sustituye completamente el proceso creativo. El reto no es solo tecnológico: es moral y educativo. 7. El papel del liderazgo institucional Los líderes educativos deben entender que el problema no se resuelve prohibiendo la IA, sino enseñando a convivir con ella. El futuro de la integridad académica dependerá de la capacidad de los directivos para diseñar políticas híbridas, donde las herramientas antiplagio evolucionen para trabajar de la mano con detectores de IA y donde el aprendizaje ético sea parte central del currículo. El liderazgo no consiste en resistir la tecnología, sino en canalizarla hacia el desarrollo responsable. El desafío de la IA generativa exige líderes que comprendan tanto la técnica como la ética del conocimiento. 8. La convergencia tecnológica: hacia sistemas integrados de integridad El futuro apunta hacia una integración entre herramientas antiplagio y detectores de IA, en un modelo de “integridad digital 360°.” Estas plataformas podrán evaluar simultáneamente la originalidad textual, la coherencia estilística, la autoría humana y el uso ético de la inteligencia artificial. De hecho, algunas soluciones emergentes ya utilizan modelos híbridos, combinando algoritmos de detección de similitud (comparativos) con redes neuronales entrenadas en identificar patrones de escritura generativa. El objetivo no será castigar el uso de IA, sino garantizar la transparencia de su participación en la creación del texto. 9. Riesgos de sobrerreacción y dependencia tecnológica Paradójicamente, el mayor riesgo no proviene solo de la IA generativa, sino también de la dependencia ciega de las herramientas antiplagio. Si las instituciones confían exclusivamente en los algoritmos sin aplicar juicio humano, podrían caer en injusticias, penalizando escritos legítimos o pasando por alto fraudes sofisticados. Por eso, la detección automatizada debe ir siempre acompañada de criterios pedagógicos y revisión humana. La tecnología identifica señales; el educador interpreta significados. Ambos deben coexistir en equilibrio. 10. Redefinir la originalidad en la era de la inteligencia artificial El mayor reto que la IA generativa plantea a las herramientas antiplagio no es técnico, sino conceptual: redefinir qué entendemos por originalidad. En una época donde las máquinas pueden crear sin copiar, la frontera entre “plagio” y “producción asistida” se vuelve difusa. Las instituciones deben avanzar hacia un nuevo modelo de integridad basada en la transparencia, donde el estudiante o autor declare explícitamente qué grado de asistencia tecnológica utilizó. De esa forma, la honestidad reemplazará a la vigilancia, y la confianza a la sospecha. Conclusión: del control a la colaboración El uso de inteligencia artificial generativa desafía a las herramientas antiplagio tradicionales porque rompe el vínculo entre texto y fuente. Obliga a los sistemas y a las instituciones a evolucionar desde la detección hacia la comprensión. El futuro de la integridad académica no se basará en perseguir copias, sino en reconocer la autoría auténtica en todas sus formas. Las herramientas deberán transformarse en guardianes de la transparencia, capaces de distinguir entre el pensamiento humano y la asistencia algorítmica, y los líderes deberán construir entornos donde la tecnología sirva para aprender, no para engañar. Así, el desafío de la IA generativa no es una amenaza, sino una oportunidad: la de redefinir el valor de la creatividad humana en un mundo donde crear ya no es exclusivo del hombre, sino una responsabilidad compartida con la máquina.

¿Qué papel juega la transparencia algorítmica en la confianza hacia las herramientas antiplagio?

¿Qué papel juega la transparencia algorítmica en la confianza hacia las herramientas antiplagio? En la era de la automatización educativa, donde las decisiones tecnológicas influyen directamente en la credibilidad institucional y en la reputación académica, el concepto de transparencia algorítmica ha emergido como un principio esencial para construir confianza entre las comunidades educativas. Las herramientas antiplagio, que analizan millones de textos, generan reportes de similitud y, en algunos casos, influyen en sanciones académicas, se encuentran en el centro de este debate. Si bien su precisión es alta, su funcionamiento sigue siendo un misterio para la mayoría de usuarios, lo que genera incertidumbre y cuestionamientos éticos. Por ello, la transparencia algorítmica no es un valor complementario, sino el cimiento sobre el que se construye la legitimidad y aceptación de estas herramientas dentro de las instituciones. 1. El contexto: decisiones automatizadas en educación Las herramientas antiplagio modernas no son simples programas de comparación textual; son sistemas complejos de inteligencia artificial que aplican modelos de lenguaje, minería de datos y aprendizaje automático. Sus reportes —a menudo representados en porcentajes de similitud o coincidencia— pueden tener consecuencias reales: desde la revisión de una tarea hasta la anulación de un título académico. Sin embargo, la mayoría de los usuarios (estudiantes, docentes o incluso autoridades) desconocen cómo el sistema llegó a esa conclusión. ¿Cuál fue la base de datos utilizada? ¿Cómo se ponderaron las coincidencias? ¿Qué criterios diferenciaron una cita legítima de un plagio? Estas preguntas, muchas veces sin respuesta, erosionan la confianza. La transparencia algorítmica se convierte, entonces, en una condición de justicia educativa. Permite entender, auditar y mejorar la tecnología para garantizar decisiones éticas, explicables y equitativas. 2. ¿Qué significa realmente transparencia algorítmica? La transparencia algorítmica implica que los procesos, parámetros y criterios utilizados por una herramienta tecnológica sean comprensibles, verificables y accesibles para los usuarios y responsables institucionales. En el caso de las herramientas antiplagio, esto significa que la institución debe conocer: Qué fuentes utiliza el sistema (bases de datos académicas, web abierta, repositorios institucionales). Cómo pondera las coincidencias y calcula los porcentajes de similitud. Qué nivel de confidencialidad aplica al almacenar o procesar los textos. Qué margen de error estadístico existe. Cómo se actualizan los modelos de detección y aprendizaje. La transparencia no significa revelar el código fuente (lo que comprometería la propiedad intelectual), sino hacer visible la lógica y los límites del algoritmo. En otras palabras, los usuarios no necesitan saber “cómo fue programado”, sino por qué decide lo que decide. 3. La confianza como activo institucional La confianza en una herramienta antiplagio no depende solo de su eficacia, sino de la percepción de equidad y claridad que genera. Cuando estudiantes y docentes comprenden cómo opera el sistema, los resultados dejan de verse como “impuestos” por una máquina y pasan a percibirse como objetivos, legítimos y verificables. La transparencia algorítmica actúa como un puente entre tecnología y comunidad, fortaleciendo la reputación institucional. Una universidad que adopta herramientas transparentes no solo protege la originalidad, sino que refuerza su cultura de ética, responsabilidad y rendición de cuentas. 4. Evitar el “caja negra”: el riesgo de lo inexplicable Muchos algoritmos modernos operan como cajas negras: ofrecen resultados exactos, pero sin explicación. Esto plantea riesgos significativos, especialmente cuando los resultados tienen implicaciones disciplinarias. Un reporte que marca 45% de similitud puede derivar en una sanción académica, pero ¿qué significa realmente ese 45%? ¿Se trata de citas correctas, coincidencias accidentales o copia literal? La falta de explicabilidad puede conducir a errores injustos o decisiones arbitrarias. Por eso, la transparencia algorítmica debe incluir mecanismos de interpretabilidad, donde los usuarios puedan comprender qué factores influyeron en el resultado y revisar los fragmentos específicos que generaron coincidencias. La clave no es solo detectar, sino explicar con claridad. 5. Regulación y ética de los algoritmos educativos La transparencia también responde a un imperativo regulatorio. En regiones como la Unión Europea, las leyes sobre inteligencia artificial y protección de datos —como el AI Act (2024) y el GDPR— establecen que toda decisión automatizada que afecte a una persona debe ser explicable y revisable. Esto aplica directamente a los sistemas antiplagio que producen reportes que pueden influir en la evaluación académica. Por tanto, los líderes educativos deben asegurarse de que las herramientas utilizadas cumplan con los principios de ética algorítmica: Responsabilidad: identificar a los responsables de las decisiones automatizadas. Justicia: garantizar que el sistema no discrimine ni genere sesgos. Privacidad: proteger la información sensible de estudiantes y autores. Auditoría: permitir revisiones independientes del funcionamiento del algoritmo. Solo las instituciones que adopten esta ética digital podrán sostener la confianza en un entorno cada vez más automatizado. 6. Transparencia técnica vs. transparencia pedagógica Es importante distinguir dos niveles de transparencia: Técnica: se refiere a los detalles operativos del algoritmo, bases de datos, ponderaciones y procesos. Pedagógica: se centra en cómo se comunica esa información a los usuarios de forma clara y comprensible. La segunda es tan importante como la primera. Una herramienta puede ser técnicamente transparente, pero inútil si los estudiantes no entienden qué significa un “40% de similitud” o cómo mejorar su texto. Por ello, los líderes educativos deben promover políticas de comunicación y capacitación que traduzcan la complejidad técnica en lenguaje educativo. El objetivo no es revelar secretos de programación, sino democratizar la comprensión tecnológica. 7. Gestión institucional y gobernanza de datos La transparencia algorítmica también implica que la institución tenga control sobre la información que se procesa. Los textos analizados por las herramientas antiplagio suelen almacenarse temporalmente o incorporarse a bases de datos para futuras comparaciones. Sin embargo, si los contratos de servicio no especifican claramente cómo se usan o se eliminan esos textos, la institución podría estar cediendo su propiedad intelectual sin saberlo. Por ello, los líderes deben revisar las políticas de privacidad y asegurar que los proveedores cumplan con las normas de gobernanza de datos, confidencialidad y soberanía digital. La transparencia algorítmica no se limita al resultado visible: abarca todo el ciclo de vida del dato, desde su captura hasta su eliminación. 8. Fomento de la cultura de integridad mediante la transparencia Cuando una institución adopta herramientas antiplagio transparentes, está enviando un mensaje poderoso: la integridad no se impone, se construye. La transparencia fomenta la autoconfianza del estudiante, quien comprende las reglas del juego y puede aprender de sus errores. También empodera al docente, que interpreta los resultados como insumos pedagógicos y no como juicios automáticos. Este enfoque participativo convierte la tecnología en una aliada del aprendizaje ético. La transparencia no solo protege la confianza; la multiplica. 9. Innovación abierta y colaboración entre instituciones La transparencia algorítmica también impulsa la colaboración académica. Las instituciones que comparten experiencias, métricas y buenas prácticas fortalecen el ecosistema educativo global. Al promover estándares abiertos de detección y evaluación, se fomenta un entorno donde la innovación tecnológica y la ética avanzan de la mano. Incluso, algunas universidades ya participan en proyectos de código abierto y consorcios de datos compartidos para crear herramientas más auditables y justas. Este modelo colaborativo puede convertirse en el futuro de la integridad digital. 10. El liderazgo como garante de transparencia Finalmente, el papel del liderazgo institucional es insustituible. Los directores de tecnología, los decanos académicos y los gerentes de calidad son los guardianes de la transparencia algorítmica. Deben exigir a los proveedores explicaciones claras, promover auditorías independientes y garantizar que los usuarios comprendan el alcance y los límites del sistema. La transparencia no ocurre sola; se gestiona y se lidera. Y en esa gestión se define la diferencia entre una institución que usa tecnología y una que construye confianza digital. Conclusión: la transparencia como puente entre la tecnología y la ética El papel de la transparencia algorítmica en la confianza hacia las herramientas antiplagio es fundamental y transformador. Permite que la tecnología opere con legitimidad, que las decisiones sean comprensibles y que la comunidad educativa confíe en los resultados. En última instancia, la integridad académica no se preserva solo detectando plagio, sino garantizando que los mecanismos de detección sean éticos, claros y humanos. La transparencia algorítmica convierte la inteligencia artificial en inteligencia confiable, y el control digital en una práctica de educación responsable y participativa. El futuro de las herramientas antiplagio no dependerá de cuán precisas sean sus máquinas, sino de cuán transparentes sean sus verdades.

¿Cómo pueden los departamentos de recursos humanos utilizar herramientas antiplagio en procesos de selección o evaluación?

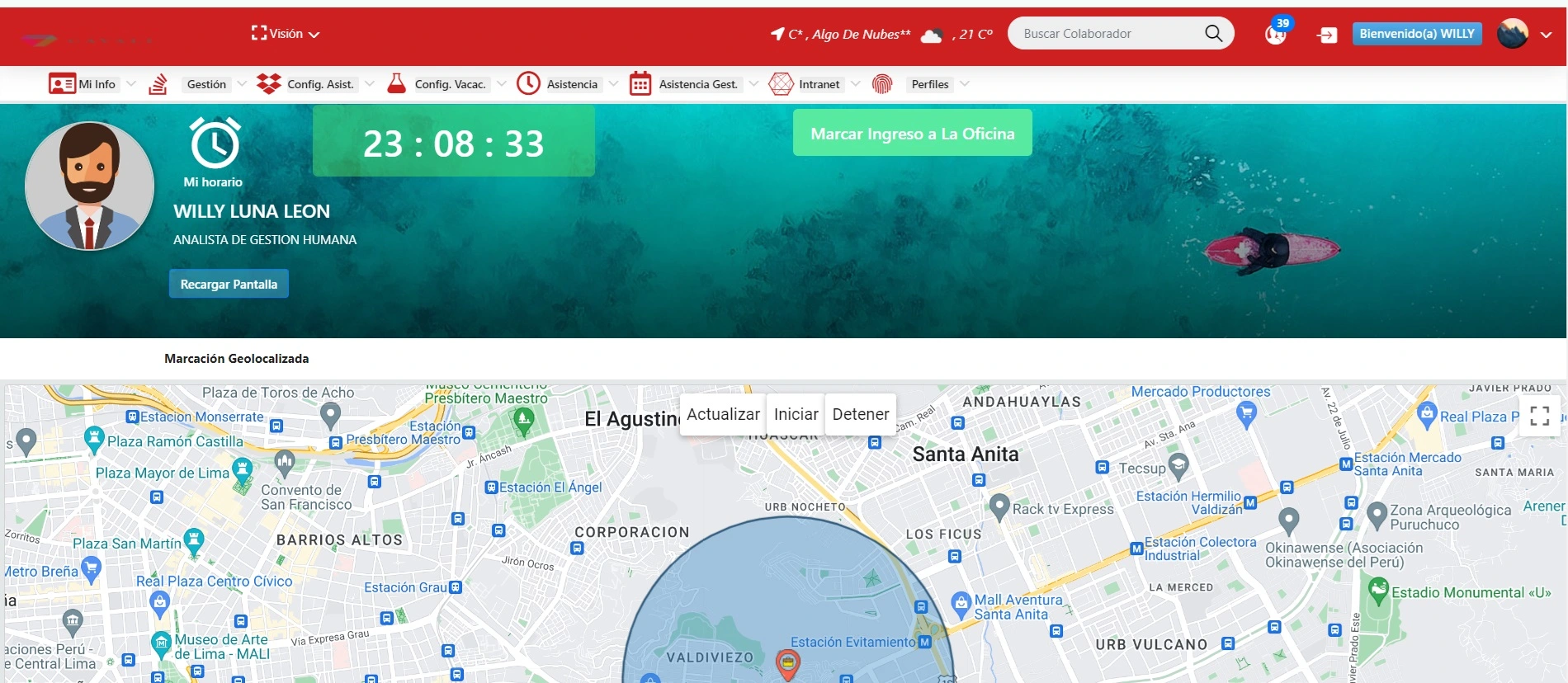

¿Cómo pueden los departamentos de recursos humanos utilizar herramientas antiplagio en procesos de selección o evaluación? Durante años, las herramientas antiplagio han sido consideradas patrimonio exclusivo del ámbito académico. Sin embargo, la creciente digitalización de los procesos corporativos y la expansión del trabajo remoto han trasladado su utilidad al mundo empresarial, especialmente a los departamentos de recursos humanos (RR. HH.). En un entorno donde la reputación corporativa, la innovación y la confianza son activos estratégicos, verificar la autenticidad y originalidad del trabajo intelectual se ha convertido en una necesidad crítica. Hoy, los líderes de RR. HH. no solo gestionan personas, sino también conocimiento, ideas y propiedad intelectual. Y en ese escenario, las herramientas antiplagio emergen como un recurso estratégico para la transparencia, la ética y la calidad organizacional. 1. La originalidad como valor corporativo En el contexto empresarial moderno, la autenticidad se ha convertido en una moneda de alto valor. Ya no basta con reclutar perfiles técnicos; las organizaciones buscan talento ético, creativo y genuino, capaz de aportar pensamiento original. Sin embargo, con la expansión del contenido digital —currículums automatizados, informes escritos por IA o presentaciones replicadas—, el riesgo de plagio corporativo ha aumentado. Los departamentos de RR. HH. enfrentan el reto de distinguir entre un candidato competente y uno que “fabrica” logros o documentos sin autoría real. Aquí, las herramientas antiplagio permiten verificar la veracidad de documentos clave: ensayos, cartas de motivación, informes de proyectos o propuestas estratégicas. De esta manera, el proceso de selección deja de ser subjetivo y se convierte en un ejercicio de verificación ética. 2. Aplicaciones prácticas en el proceso de selección Los procesos de contratación modernos suelen incluir etapas donde el candidato debe redactar documentos o presentar análisis. En estos casos, las herramientas antiplagio pueden aplicarse en tres momentos estratégicos: a) Evaluación de documentos de postulación: Los currículums, cartas de presentación y portafolios digitales pueden ser revisados para detectar fragmentos copiados de internet o plantillas genéricas sin valor diferencial. Esto permite identificar candidatos que no reflejan autenticidad ni pensamiento propio. b) Pruebas técnicas o ensayos durante el proceso: Cuando un postulante entrega un análisis, propuesta o ensayo, la herramienta antiplagio verifica su originalidad antes de ser evaluado por el comité. Esto garantiza que la evaluación mida realmente las competencias del candidato y no su habilidad para copiar o usar IA sin criterio ético. c) Contrataciones académicas, científicas o creativas: En sectores donde la producción intelectual es central (educación, comunicación, diseño, investigación), las herramientas antiplagio permiten verificar artículos, papers, presentaciones o materiales docentes. Así, la institución protege su reputación y evita litigios por plagio involuntario o mala praxis profesional. 3. Evaluación del desempeño y cultura de integridad Más allá de la selección, las herramientas antiplagio son útiles en la evaluación del desempeño profesional. En organizaciones donde los empleados producen informes, políticas internas o documentos de conocimiento, la detección de originalidad puede integrarse como parte del control de calidad. Por ejemplo: En empresas de consultoría, se puede verificar que los informes entregados a los clientes no reproduzcan materiales de otros proyectos. En editoriales o agencias creativas, se revisan textos, campañas o guiones. En universidades o centros de formación, se aplican a manuales docentes, presentaciones y exámenes. Esto no busca penalizar, sino fomentar la integridad profesional y el respeto por la propiedad intelectual. Un sistema que evalúa con justicia promueve un entorno donde la creatividad y la transparencia son la norma. 4. Protección de la reputación corporativa y del know-how La reputación es uno de los activos más valiosos de cualquier organización. Un caso de plagio o copia de propiedad intelectual puede afectar gravemente la imagen institucional y, en algunos casos, generar repercusiones legales. Las herramientas antiplagio ayudan a prevenir estos riesgos, asegurando que los documentos corporativos, políticas internas o materiales de comunicación sean originales y legítimos. Además, estas herramientas pueden aplicarse en la protección del conocimiento interno. Las empresas pueden cargar documentos estratégicos en los sistemas antiplagio para evitar que sean replicados externamente o publicados sin autorización. De este modo, las herramientas actúan también como sistemas de seguridad intelectual. 5. Uso de inteligencia artificial en RR. HH. y riesgos asociados El auge de la IA generativa también ha llegado a los departamentos de RR. HH. Muchos candidatos utilizan ChatGPT o herramientas similares para crear documentos de postulación o responder pruebas. Aunque esto no siempre constituye plagio, sí plantea un dilema ético: ¿hasta qué punto un texto generado por IA representa realmente las capacidades de un individuo? Aquí las herramientas antiplagio evolucionan hacia sistemas de detección de escritura artificial, que identifican patrones lingüísticos propios de la IA. De esta manera, los responsables de selección pueden distinguir entre un texto humano y uno sintético, preservando la autenticidad del proceso de evaluación. 6. Integración con plataformas de gestión del talento Las herramientas antiplagio pueden integrarse fácilmente con plataformas de gestión del talento o LMS corporativos (Learning Management Systems) mediante API o LTI. Esto permite automatizar la revisión de documentos, ensayos o reportes en procesos de formación interna, promoción y certificación. Por ejemplo, si un colaborador presenta un proyecto de innovación o un trabajo final de un curso de liderazgo, el sistema puede verificar automáticamente su originalidad antes de su evaluación. De esta forma, la organización promueve una cultura de mérito auténtico y aprendizaje honesto. 7. Ética y privacidad en la implementación La aplicación de herramientas antiplagio en el ámbito laboral debe realizarse con rigurosos criterios éticos. No se trata de convertir la evaluación en vigilancia, sino de establecer procesos transparentes y justos. Los candidatos y empleados deben ser informados de manera clara sobre el uso de estas herramientas, los fines del análisis y la confidencialidad de sus documentos. El respeto por la privacidad y los derechos de autor es fundamental. Los textos evaluados deben procesarse en entornos seguros, con encriptación y sin almacenamiento permanente sin consentimiento. Así, la organización equilibra la integridad con la confianza, garantizando que la detección no se perciba como control, sino como garantía de equidad profesional. 8. Formación y sensibilización del talento interno El uso de herramientas antiplagio también puede integrarse en los programas de formación corporativa. Capacitar a los colaboradores en buenas prácticas de citación, redacción original y uso ético de la información fortalece la cultura de integridad. Al mismo tiempo, enseñar a interpretar los reportes de similitud convierte la tecnología en una herramienta de aprendizaje continuo. Un equipo consciente de la importancia de la originalidad se convierte en un activo ético y competitivo, capaz de generar valor sin comprometer los principios de la organización. 9. Beneficios para la gestión estratégica de RR. HH. Implementar herramientas antiplagio en los procesos de RR. HH. ofrece beneficios tangibles y estratégicos: Prevención de riesgos reputacionales. Garantía de transparencia en la selección. Fortalecimiento de la cultura de integridad. Protección del conocimiento institucional. Alineación entre ética y desempeño. Evidencia documental para auditorías o procesos de compliance. Estas ventajas posicionan al área de recursos humanos como un actor clave en la gobernanza ética de la organización. 10. El liderazgo ético como motor del cambio Finalmente, el éxito de la implementación depende del liderazgo. Los directores de RR. HH. deben asumir el rol de guardianes de la integridad institucional, promoviendo un equilibrio entre tecnología y humanidad. Su tarea no es solo adoptar herramientas, sino inspirar comportamientos honestos y educar en el valor de la originalidad como expresión de identidad profesional. Cuando la tecnología se usa con propósito, deja de ser un filtro para convertirse en una herramienta de evolución organizacional. La integridad no se impone, se cultiva. Conclusión: de la verificación a la cultura Las herramientas antiplagio, aplicadas en los departamentos de recursos humanos, trascienden la detección técnica para convertirse en instrumentos de ética corporativa. Permiten validar el mérito, proteger la reputación y promover una cultura donde la transparencia y la creatividad son valores compartidos. En un mundo laboral impulsado por la inteligencia artificial, la confianza será el nuevo capital humano. Y las organizaciones que integren tecnología con principios serán las que lideren con credibilidad. Porque en última instancia, el talento no solo se mide por lo que sabe hacer, sino por la honestidad con que lo hace.

¿Qué diferencias existen entre el plagio detectado en textos, imágenes o código fuente?

¿Qué diferencias existen entre el plagio detectado en textos, imágenes o código fuente? El plagio no es un fenómeno exclusivo del lenguaje escrito: se manifiesta también en múltiples formas de creación intelectual —textos, imágenes, diseños, videos, código de programación o incluso modelos de datos—. Cada una de estas modalidades presenta características, riesgos y métodos de detección distintos, y las herramientas antiplagio deben adaptarse a los lenguajes y estructuras propias de cada formato. En un entorno donde la creatividad se diversifica y la tecnología permite copiar con un clic, comprender las diferencias entre los tipos de plagio se vuelve indispensable para directores académicos, responsables de innovación y líderes tecnológicos que buscan garantizar integridad y protección del conocimiento. 1. El plagio textual: la forma más conocida y controlada El plagio textual es el más común y el primero que dieron origen a las herramientas antiplagio tradicionales. Consiste en copiar parcial o totalmente fragmentos de un texto sin citar adecuadamente la fuente o presentando como propias ideas ajenas. Los sistemas modernos utilizan procesamiento de lenguaje natural (NLP) y comparaciones con bases de datos académicas, web abierta, artículos científicos y repositorios institucionales. Detectan coincidencias exactas, parafraseos, traducciones o reorganizaciones de contenido. Ejemplo típico: un estudiante copia párrafos de Wikipedia o de una tesis publicada, cambia algunas palabras y los presenta como suyos. El reto actual es la detección de textos reescritos por inteligencia artificial, donde no existe copia directa, pero sí una reproducción conceptual. Las nuevas herramientas basadas en IA ya incorporan detección de patrones sintácticos y probabilísticos para distinguir escritura humana de escritura generativa. 2. Plagio visual: la apropiación del lenguaje gráfico El plagio de imágenes o contenido visual abarca desde fotografías hasta ilustraciones, infografías, logotipos o diseños artísticos. A diferencia del texto, aquí la detección no depende de las palabras, sino de patrones visuales, composición, colorimetría y metadatos. Las herramientas especializadas utilizan visión computacional y reconocimiento de imágenes (Computer Vision). Mediante algoritmos de coincidencia de píxeles, análisis de formas o lectura de huellas digitales (hashing), pueden identificar similitudes incluso cuando la imagen ha sido modificada —recortada, rotada, editada o coloreada de otro modo—. Ejemplo: un diseñador toma una fotografía de banco de imágenes, cambia los tonos y la presenta como original. Aunque la copia no sea literal, la estructura visual revela el plagio. La IA generativa ha multiplicado este desafío: hoy pueden crearse imágenes nuevas a partir de las existentes (por ejemplo, mediante DALL·E o Midjourney). Las herramientas antiplagio visual ahora deben incluir detección de procedencia (provenance detection) para rastrear si la imagen tiene componentes derivados de obras previas protegidas por derechos de autor. 3. Plagio en código fuente: el reto de la lógica y la estructura El plagio en programación o código fuente representa una forma más técnica pero igualmente crítica, especialmente en educación tecnológica, ingeniería y desarrollo de software corporativo. Aquí, el plagio no se da tanto en el texto literal, sino en la estructura lógica y funcional del código. Dos programas pueden verse diferentes —con variables o comentarios modificados— y sin embargo ejecutar exactamente las mismas operaciones. Por eso, las herramientas antiplagio para código (como Moss, JPlag, Codequiry o Turnitin Code Compare) no comparan palabras, sino patrones estructurales, flujo lógico y sintaxis funcional. Estas soluciones utilizan árboles de sintaxis abstracta (AST) y algoritmos de análisis estático para identificar similitudes entre funciones, bucles y estructuras condicionales. También miden la complejidad del código y la secuencia lógica de ejecución, permitiendo detectar copias sofisticadas incluso con alteraciones menores. Ejemplo: dos estudiantes presentan programas con diferentes nombres de variables, pero idéntica lógica de ejecución. Un detector de texto no vería coincidencia, pero un analizador de estructura sí. 4. Plagio en audio, video y multimedia El ámbito audiovisual plantea retos aún más complejos. En videos, podcasts y materiales interactivos, el plagio puede implicar la reutilización no autorizada de voz, música, guion o secuencias de imagen. Los detectores modernos combinan análisis espectral, reconocimiento de voz y rastreo de huellas digitales multimedia. Estos sistemas extraen fragmentos de audio y video y los comparan con bases de datos globales de contenidos registrados (como YouTube Content ID o Audible Magic). El resultado es una verificación de propiedad y originalidad que protege tanto a creadores como a instituciones. La creciente adopción de deepfakes y contenidos generados por IA vuelve indispensable el desarrollo de marcadores de autenticidad digital, como el estándar C2PA (Coalition for Content Provenance and Authenticity), que asegura el origen legítimo del contenido. 5. Diferencias técnicas en los métodos de detección Tipo de Plagio Tecnología principal Nivel de complejidad Riesgo de falsos positivos Ejemplo Textual Procesamiento de lenguaje natural (NLP), coincidencia semántica Medio Bajo Copiar párrafos o ideas de un artículo sin citar Visual Visión computacional, detección de patrones, hashing Alto Medio Usar una imagen editada sin permiso Código fuente Análisis estructural, árboles de sintaxis, comparación lógica Muy alto Bajo Copiar la lógica de un programa Audiovisual Reconocimiento espectral, fingerprinting, IA generativa inversa Muy alto Medio/alto Reutilizar fragmentos de video o audio sin atribución Cada modalidad requiere una estrategia y una herramienta específica. El gran error institucional es aplicar un único modelo de detección para todos los formatos, lo que deja brechas importantes en la protección de la propiedad intelectual. 6. Implicaciones legales y éticas Desde el punto de vista jurídico, el plagio —en cualquiera de sus formas— constituye una violación de los derechos de autor. Sin embargo, el tratamiento legal puede variar según el tipo de contenido y la jurisdicción. En textos y código, las sanciones se basan en la reproducción no autorizada del contenido. En imágenes y video, puede implicar además infracción de licencias de uso o derechos de imagen. En materiales generados por IA, aún se debate la titularidad del contenido sintético, un vacío legal que las instituciones deben abordar mediante políticas internas de propiedad intelectual. En el terreno ético, las diferencias entre formatos no alteran el principio esencial: atribuir siempre la fuente y reconocer la autoría ajena. 7. Integración institucional: hacia una visión 360° de la originalidad Las universidades y organizaciones modernas ya avanzan hacia ecosistemas de detección integral, donde distintas herramientas se combinan bajo un mismo marco de integridad digital. Por ejemplo: Los textos se analizan con Turnitin o Grammarly. Las imágenes, con TinEye o Google Vision. El código, con Moss o Codequiry. Los videos, con sistemas de autenticación multimedia. Estas plataformas pueden integrarse en el LMS institucional o en los sistemas de gestión documental corporativos, permitiendo verificar simultáneamente la autenticidad de todos los tipos de producción. Esta visión 360° de la originalidad convierte la detección en una práctica sistemática y preventiva, no reactiva. El objetivo no es castigar, sino educar en la ética del conocimiento. 8. Desafíos emergentes ante la IA generativa La inteligencia artificial generativa ha difuminado aún más las fronteras del plagio. Hoy, un estudiante o empleado puede generar una imagen, un texto o incluso un código completamente nuevo, pero basado en miles de ejemplos previos de autores reales. El contenido no es una copia, pero tampoco una creación puramente humana. Por ello, los detectores deben evolucionar hacia sistemas de trazabilidad digital, capaces de identificar el “ADN algorítmico” de una creación. La transparencia sobre el uso de IA (mediante etiquetas o metadatos de autoría) será clave para garantizar autenticidad sin criminalizar la innovación. 9. Perspectiva gerencial: gestión del riesgo reputacional Para los directivos y responsables de tecnología, comprender las diferencias entre tipos de plagio no es un asunto técnico, sino estratégico. Un plagio en código o imagen puede tener el mismo impacto reputacional que uno textual, o incluso mayor si compromete la identidad visual o tecnológica de la institución. La implementación de un sistema integral de detección debe acompañarse de políticas claras de derechos de autor, capacitación continua y protocolos de actuación ante hallazgos. El liderazgo ético implica prevenir antes que sancionar. 10. Conclusión: la integridad como lenguaje universal El plagio, sea textual, visual o lógico, tiene una raíz común: la falta de reconocimiento de la autoría ajena. Sin embargo, cada formato requiere un lenguaje de detección y prevención diferente. Comprender esas diferencias permite a las instituciones y empresas construir entornos más seguros, creativos y respetuosos. Las herramientas antiplagio del futuro no solo analizarán palabras, píxeles o líneas de código, sino que evaluarán la autenticidad como un principio transversal del conocimiento humano. En un mundo donde la tecnología difumina las fronteras entre copiar y crear, la verdadera innovación residirá en mantener la ética como denominador común de todas las formas de expresión.

¿Cómo equilibrar la automatización con la revisión humana en los procesos antiplagio?

¿Cómo equilibrar la automatización con la revisión humana en los procesos antiplagio? En la actualidad, las herramientas antiplagio se han convertido en parte esencial de la gestión educativa y corporativa. Su capacidad para analizar grandes volúmenes de información en segundos, detectar similitudes y generar reportes detallados las hace indispensables para garantizar la integridad y la transparencia. Sin embargo, confiar ciegamente en los resultados de estas herramientas puede generar errores de interpretación, sanciones injustas o pérdida de criterio crítico. Por eso, el verdadero desafío de las instituciones modernas no es solo implementar tecnología, sino equilibrar la automatización con la revisión humana. Este equilibrio no es una cuestión técnica, sino cultural, ética y estratégica: se trata de encontrar la armonía entre la precisión del algoritmo y la sensibilidad del juicio humano. 1. La automatización: velocidad, escala y precisión técnica Las herramientas antiplagio modernas —impulsadas por inteligencia artificial, aprendizaje automático y procesamiento de lenguaje natural— ofrecen ventajas indiscutibles: Pueden analizar millones de documentos simultáneamente. Detectan patrones, parafraseos y traducciones con una exactitud que supera la revisión manual. Reducen tiempos administrativos y liberan carga operativa. Generan trazabilidad y evidencia documental para auditorías. Desde la perspectiva institucional, esta automatización representa un salto de eficiencia, permitiendo controlar la integridad en todos los niveles —desde trabajos estudiantiles hasta informes corporativos o artículos científicos—. Pero el riesgo surge cuando la velocidad se convierte en sustituto del razonamiento. 2. El límite del algoritmo: los falsos positivos y la interpretación contextual Por muy sofisticada que sea, una herramienta antiplagio no entiende la intención humana. Los algoritmos detectan coincidencias, pero no interpretan matices. Pueden marcar como plagio una cita correctamente referenciada, un fragmento técnico que por naturaleza es similar a otros, o una coincidencia casual en expresiones comunes. Estos casos, conocidos como falsos positivos, representan uno de los mayores riesgos de la automatización sin control humano. Un informe que muestra un “45% de similitud” no significa necesariamente que el trabajo esté copiado. Solo un evaluador humano puede determinar si esas coincidencias son legítimas o constituyen una falta ética. Por eso, las instituciones deben evitar la delegación ciega en la máquina y promover una lectura crítica de los reportes. 3. La revisión humana: el juicio, la ética y el contexto El componente humano en los procesos antiplagio no puede eliminarse, porque la integridad no es una métrica, es un valor. El docente, evaluador o gestor académico aporta lo que ninguna máquina puede: el juicio contextual. Solo un humano puede: Evaluar la intención del autor. Distinguir entre descuido y mala fe. Analizar el contexto académico o cultural del texto. Ofrecer retroalimentación ética y formativa. Por ello, los reportes generados por las herramientas deben ser puntos de partida, no veredictos finales. La revisión humana asegura que la justicia académica prevalezca sobre la rigidez algorítmica. 4. Modelos híbridos: la sinergia entre IA y evaluación humana El futuro de la integridad académica y corporativa se orienta hacia modelos híbridos, donde la automatización y la supervisión humana trabajan de forma complementaria. Este modelo funciona mediante tres fases: a) Detección automática: El sistema analiza el documento y genera un reporte de similitud basado en su base de datos y algoritmos semánticos. b) Evaluación humana: El docente o evaluador revisa el informe, interpreta las coincidencias y determina si hay plagio o solo similitud legítima. c) Retroalimentación formativa: El evaluador comunica al autor los hallazgos, explica los errores y ofrece orientación sobre cómo mejorar la escritura y la citación. Esta sinergia convierte la detección en aprendizaje activo y promueve una cultura de integridad más profunda. 5. Capacitación y alfabetización digital ética Para lograr este equilibrio, las instituciones deben invertir en formación continua. No basta con capacitar en el uso técnico de las herramientas; es necesario enseñar a interpretar los resultados, comprender los límites de los algoritmos y aplicar criterios éticos sólidos. Los docentes y líderes deben aprender a leer los informes de similitud con mirada crítica, evitando sancionar automáticamente sin analizar el contenido. Asimismo, los estudiantes o colaboradores deben entender cómo funcionan las herramientas, qué buscan y cómo evitar coincidencias innecesarias mediante una escritura ética y consciente. Esta alfabetización ética digital se convierte en la base para humanizar la automatización. 6. La importancia del protocolo institucional El equilibrio entre automatización y revisión humana también debe formalizarse en protocolos institucionales claros. Estos deben establecer: Cómo y cuándo se aplican las herramientas. Qué umbrales de similitud son aceptables. Quiénes son los responsables de interpretar los resultados. Qué procedimientos seguir en caso de presunto plagio. Qué derechos tienen los autores para revisar o apelar los resultados. Un protocolo transparente protege tanto a la institución como a los usuarios, garantizando equidad, consistencia y justicia. 7. Los riesgos de la automatización sin criterio humano Las instituciones que confían ciegamente en la automatización pueden caer en tres errores graves: Injusticia académica: sancionar por coincidencias irrelevantes. Desmotivación del usuario: convertir la tecnología en un mecanismo de control, no de aprendizaje. Deshumanización del proceso educativo: delegar la enseñanza de la ética a un algoritmo. El resultado puede ser una cultura del miedo, donde los estudiantes escriben para evitar sanciones, no para aprender. El equilibrio, en cambio, fomenta una cultura del mérito y la autorreflexión. 8. Beneficios del enfoque equilibrado Cuando la automatización y la revisión humana se integran correctamente, las instituciones obtienen beneficios significativos: Mayor precisión en la detección y sanción de casos reales. Fortalecimiento de la confianza entre docentes y estudiantes. Evidencia objetiva, respaldada por criterio humano. Educación ética, no solo control digital. Reducción de conflictos y apelaciones innecesarias. En este modelo, la tecnología actúa como un espejo que muestra la realidad, y el ser humano como el juez que interpreta su reflejo. 9. Inteligencia artificial explicable y transparencia La nueva generación de herramientas antiplagio basadas en IA busca precisamente facilitar la revisión humana mediante explicaciones claras de sus decisiones. Esta tendencia, conocida como IA explicable (Explainable AI), ofrece reportes visuales, justificaciones detalladas y segmentaciones de coincidencias con enlaces directos a las fuentes. Esto permite que el evaluador humano comprenda por qué el sistema marcó un fragmento y decida si la coincidencia es significativa. La transparencia algorítmica se convierte en un aliado del equilibrio, no en una amenaza. 10. Conclusión: tecnología al servicio del juicio humano El equilibrio entre automatización y revisión humana en los procesos antiplagio no consiste en elegir entre máquina o persona, sino en reconciliar la eficiencia con la sabiduría. La automatización garantiza rapidez y consistencia; el ser humano aporta contexto, empatía y justicia. Las instituciones más avanzadas no son las que más confían en la IA, sino las que mejor la humanizan. El futuro de la integridad académica y corporativa dependerá de mantener viva esa dualidad: que la máquina detecte, pero que el ser humano decida, eduque y guíe. En última instancia, la tecnología debe ser el instrumento de la ética, no su reemplazo. Porque la integridad —como el aprendizaje— no puede automatizarse, solo cultivarse.

¿Qué riesgos existen en depender exclusivamente de herramientas automáticas para detectar plagio?