Índice del contenido

¿Qué impacto tiene el proctoring IA sobre la cultura organizacional de una empresa?

La implementación de tecnologías de supervisión automatizada, como el proctoring con inteligencia artificial (IA), no solo representa un avance en la administración de exámenes y formaciones digitales, sino que también genera una transformación profunda en la cultura organizacional de las empresas. Cuando hablamos de cultura organizacional, nos referimos a ese conjunto de valores, creencias, hábitos, normas y formas de actuar que definen el día a día de una compañía. Incorporar una herramienta como el proctoring IA afecta inevitablemente esos elementos, y su impacto puede ser tanto positivo como negativo, dependiendo del enfoque, la transparencia y la forma en que se gestione dicha implementación. En primer lugar, es importante entender que el proctoring IA simboliza una forma de control, automatización y vigilancia. Al introducir este tipo de tecnología en el contexto de formación y evaluación interna, la empresa emite un mensaje claro a sus colaboradores: los procesos deben ser rigurosos, medibles y justos. Este enfoque puede ser interpretado como una apuesta por la meritocracia y la transparencia, lo cual podría fortalecer una cultura organizacional orientada al alto rendimiento. No obstante, también puede ser recibido con desconfianza o resistencia si no se comunica adecuadamente. Uno de los impactos más visibles del proctoring IA en la cultura organizacional es el cambio en la percepción de la confianza. En muchas organizaciones, especialmente aquellas que priorizan la autonomía del trabajador, la confianza es un valor esencial. La incorporación de una herramienta de vigilancia automatizada durante los procesos de capacitación o certificación puede ser percibida como una señal de desconfianza hacia los empleados. Si no se maneja con cuidado, esto puede erosionar los vínculos de confianza que la organización ha construido durante años. Por eso, el liderazgo debe acompañar la implementación con un discurso claro: la IA no reemplaza la confianza, sino que garantiza la equidad en procesos críticos. Otro aspecto relevante es el impacto sobre la percepción de modernidad e innovación de la empresa. Las organizaciones que integran soluciones basadas en inteligencia artificial como el proctoring se posicionan, ante sus empleados y stakeholders, como compañías que están a la vanguardia tecnológica. Este tipo de posicionamiento puede generar un efecto motivacional y de orgullo entre los colaboradores, especialmente si la empresa también promueve una cultura de aprendizaje continuo y desarrollo profesional. Implementar proctoring IA, en ese contexto, no se ve como una medida de control, sino como una extensión natural de una cultura que apuesta por la transformación digital. Sin embargo, el impacto no siempre es uniforme. Las empresas que tienen una cultura más tradicional o jerárquica pueden experimentar choques culturales importantes. Por ejemplo, en organizaciones donde no hay precedentes de digitalización o donde el teletrabajo aún genera resistencia, la introducción de una herramienta de vigilancia automatizada puede generar temores relacionados con la pérdida de privacidad, el aumento del control y la deshumanización de los procesos. En estos casos, la implementación debe ir acompañada de campañas internas de concientización, formación ética y una política de gobernanza de IA clara, que garantice que los derechos de los empleados serán respetados. Desde el punto de vista de los líderes de recursos humanos, el impacto del proctoring IA también se extiende a la forma en que se diseñan e interpretan los procesos de evaluación. Con esta tecnología, los líderes pueden obtener datos objetivos y trazables sobre el comportamiento de los evaluados durante una sesión formativa, lo que permite tomar decisiones basadas en evidencia. Esta capacidad analítica fortalece una cultura basada en resultados, donde la toma de decisiones se apoya en métricas y patrones verificables. A largo plazo, esto puede mejorar la transparencia en los ascensos, la asignación de responsabilidades o incluso el diseño de programas de desarrollo. Asimismo, la incorporación del proctoring IA cambia la narrativa interna sobre la responsabilidad individual. Cuando los empleados saben que los exámenes o certificaciones están siendo supervisados por un sistema inteligente, la probabilidad de que intenten cometer fraude disminuye. Esto no solo garantiza la validez del proceso evaluativo, sino que también promueve un sentido de responsabilidad y profesionalismo. Es decir, se fortalece una cultura organizacional donde se espera que cada colaborador actúe con integridad, incluso cuando no hay un supervisor humano observando. No obstante, no podemos ignorar los efectos psicológicos que esta tecnología puede tener. Algunos empleados pueden experimentar ansiedad o incomodidad al ser vigilados por una IA, especialmente si no comprenden cómo funciona el sistema, qué información recopila o cómo se procesan sus datos. Esto puede crear un clima organizacional tenso o incluso propiciar el ausentismo en procesos de formación. Para evitarlo, es indispensable que la empresa acompañe la implementación con una estrategia comunicacional robusta, donde se informe de manera clara, honesta y transparente cuáles son los límites del sistema y cómo se protege la privacidad del usuario. Por último, el proctoring IA puede ser una herramienta para reforzar los valores de equidad e inclusión en la organización. Un sistema bien calibrado puede eliminar sesgos humanos en la supervisión, aplicar las mismas reglas a todos y ofrecer adaptaciones para personas con discapacidades o necesidades especiales. Esto tiene un impacto directo en la cultura organizacional, promoviendo valores como la equidad, la igualdad de oportunidades y la inclusión. Sin embargo, esto solo se logra si el diseño del sistema considera activamente estos factores desde el inicio.

¿Qué desafíos éticos presenta el uso de IA en la supervisión de evaluaciones virtuales?

La supervisión de evaluaciones virtuales mediante inteligencia artificial ha ganado terreno de manera vertiginosa en los últimos años, especialmente en el ámbito empresarial y educativo. Si bien esta tecnología permite garantizar la integridad de los procesos de evaluación y facilita la gestión masiva de capacitaciones, también plantea una serie de desafíos éticos que deben ser abordados con profundidad y responsabilidad. Para un líder organizacional o responsable de talento humano, comprender estos desafíos es clave para garantizar una implementación alineada con los principios de respeto, equidad y justicia. Uno de los principales desafíos éticos tiene que ver con la privacidad de los empleados o evaluados. Las soluciones de proctoring basadas en IA suelen recopilar grandes cantidades de datos, incluyendo imágenes en tiempo real, audio ambiental, patrones de comportamiento, movimientos oculares y actividad en pantalla. Aunque esta información es útil para detectar comportamientos sospechosos o posibles fraudes, su recopilación masiva y automatizada puede considerarse intrusiva. En este contexto, las empresas deben ser extremadamente cuidadosas para asegurar que esta recopilación se realice con consentimiento informado, transparencia y dentro de los límites legales vigentes. La transparencia algorítmica es otro de los grandes retos. Muchos sistemas de proctoring funcionan como “cajas negras”, es decir, sus criterios de detección de fraude no son del todo comprensibles ni accesibles para los usuarios. Esto plantea serias preocupaciones, ya que una persona puede ser injustamente penalizada sin comprender exactamente qué comportamiento generó la alerta. Para los líderes de una organización, este escenario representa un riesgo reputacional y legal importante, especialmente si los afectados no cuentan con mecanismos de apelación o revisión. Por lo tanto, uno de los principios éticos fundamentales es garantizar la explicabilidad del sistema: que los algoritmos puedan justificar sus decisiones de manera comprensible para los humanos. Un desafío ético adicional es el sesgo algorítmico. La IA aprende en función de los datos con los que ha sido entrenada, y si esos datos contienen sesgos (por ejemplo, por raza, género, edad o comportamiento cultural), el sistema puede replicar esos sesgos en sus evaluaciones. Esto puede resultar en un trato desigual, especialmente en entornos corporativos globales donde los colaboradores provienen de contextos diversos. Para mitigar este riesgo, es vital que los sistemas de proctoring sean auditados de forma constante y que se implementen mecanismos de validación ética durante su diseño, entrenamiento y operación. También existe una dimensión ética relacionada con el bienestar emocional de los evaluados. Estar bajo supervisión continua por parte de un sistema automatizado puede generar ansiedad, incomodidad o incluso sensaciones de desconfianza. Esta presión puede afectar el rendimiento y generar un clima adverso durante los procesos de aprendizaje o evaluación. En este sentido, el principio de proporcionalidad ética sugiere que la intensidad del control debe ser coherente con la relevancia del proceso evaluativo. No es lo mismo aplicar un proctoring exhaustivo en una certificación crítica de ciberseguridad que en una evaluación introductoria de onboarding. El consentimiento informado es otro principio ético esencial. Muchas veces, los colaboradores o evaluados no comprenden del todo lo que implica ser vigilado por una IA: qué datos se recogen, cómo se usan, quién los ve, cuánto tiempo se almacenan y qué consecuencias pueden derivarse. La empresa debe asegurarse de que todos los involucrados reciban información clara, accesible y suficiente antes de comenzar el proceso. Y, más aún, debe ofrecer la posibilidad de optar por una alternativa en caso de que alguien no se sienta cómodo con este tipo de supervisión, siempre que la criticidad del proceso lo permita. Finalmente, no se puede dejar de lado el principio de justicia organizacional. Cualquier implementación de IA debe buscar promover un trato justo, igualitario y respetuoso con todas las personas involucradas. Si la herramienta de proctoring se convierte en una barrera para ciertos grupos o si se usa para penalizar sin contexto, la organización corre el riesgo de deteriorar su reputación interna y externa. Por eso, el diseño ético debe ir acompañado de políticas corporativas que garanticen la supervisión humana, canales de reclamo, acompañamiento psicológico si es necesario y una revisión continua del sistema.

¿Qué diferencias existen entre un sistema de proctoring tradicional y uno impulsado por IA?

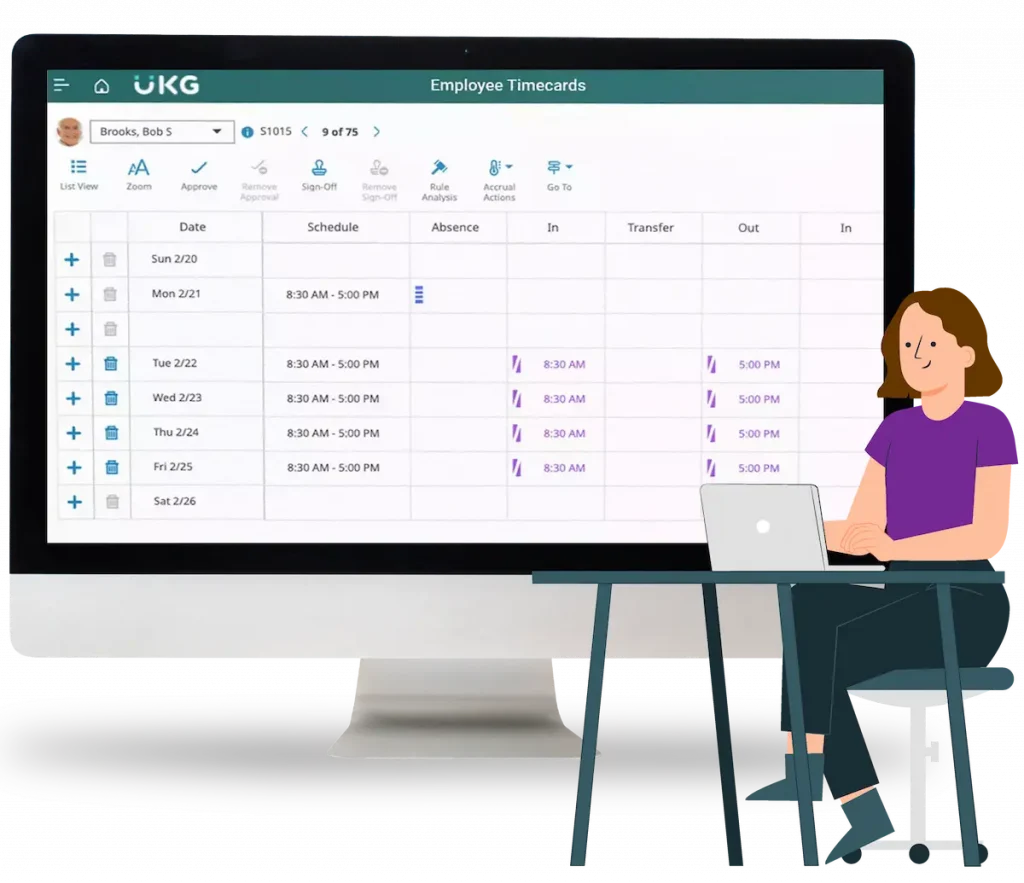

Comprender las diferencias entre un sistema de proctoring tradicional y uno impulsado por inteligencia artificial (IA) es esencial para que los líderes empresariales tomen decisiones informadas sobre la implementación de herramientas tecnológicas en sus programas de formación. Ambos modelos tienen como objetivo garantizar la integridad de los procesos evaluativos, pero la manera en que lo hacen, los recursos que utilizan y los resultados que generan son fundamentalmente distintos. Estas diferencias no solo impactan en lo técnico, sino también en lo ético, lo operativo y lo cultural dentro de una organización. En primer lugar, el proctoring tradicional se basa principalmente en la supervisión humana. Por lo general, esto implica que un evaluador, supervisor o vigilante observe a los participantes durante la realización de un examen, ya sea de forma presencial o virtual. En el entorno digital, este tipo de proctoring suele realizarse mediante videollamadas en vivo, donde uno o varios supervisores monitorizan a múltiples candidatos a través de sus cámaras. Este modelo tiene la ventaja de la interpretación humana en tiempo real, lo que permite cierto nivel de contextualización ante comportamientos ambiguos. Sin embargo, también tiene limitaciones significativas en cuanto a escalabilidad, consistencia, eficiencia operativa y costos. Por el contrario, el proctoring con IA representa una evolución hacia la automatización inteligente del proceso de vigilancia. Utiliza una combinación de algoritmos de visión por computadora, aprendizaje automático y procesamiento de datos en tiempo real para supervisar a los candidatos sin intervención humana directa. Esta tecnología puede detectar movimientos sospechosos, desviaciones de la mirada, presencia de voces externas, uso no autorizado de software o patrones de comportamiento atípicos con una precisión creciente. En esencia, reemplaza o complementa la supervisión humana con un sistema que puede operar 24/7, sobre miles de usuarios simultáneamente y con capacidad de análisis predictivo. Una diferencia crucial está en la escalabilidad. Los sistemas tradicionales requieren una proporción directa entre supervisores y evaluados. Si una empresa desea certificar a 500 empleados al mismo tiempo, necesitará una cantidad similar de recursos humanos para la supervisión o al menos una logística compleja para garantizar cobertura. El proctoring con IA, en cambio, permite supervisar a miles de personas en paralelo sin incrementar proporcionalmente los costos operativos. Esta capacidad es particularmente útil en organizaciones que están implementando programas de formación global o certificaciones corporativas masivas. Otro aspecto fundamental es la objetividad. La supervisión humana está sujeta a la fatiga, los prejuicios, la subjetividad y la variabilidad entre observadores. Lo que un supervisor considera sospechoso, otro puede interpretarlo como inofensivo. Esto genera inconsistencias en la evaluación de los resultados y puede abrir la puerta a reclamaciones o injusticias. La IA, al estar basada en parámetros definidos y entrenamientos masivos, ofrece mayor uniformidad en la detección de incidencias. Además, puede aprender y ajustarse continuamente mediante algoritmos de machine learning, lo que incrementa su precisión con el tiempo. En el terreno de la recolección y análisis de datos, el proctoring con IA también representa una revolución. Mientras que en el sistema tradicional los supervisores toman nota manual de los incidentes, en el modelo automatizado se generan reportes detallados, auditables y trazables, con timestamps, clips de video de los eventos relevantes, puntuaciones de riesgo y otros indicadores cuantitativos. Esto permite a los equipos de recursos humanos y tecnología tomar decisiones basadas en evidencia, identificar patrones de comportamiento, ajustar políticas internas y mejorar continuamente el sistema formativo. Desde el punto de vista de la experiencia del usuario, ambos modelos presentan ventajas y desventajas. Algunos candidatos pueden sentirse más cómodos sabiendo que hay una persona humana al otro lado de la pantalla, mientras que otros valoran la discreción y neutralidad de ser evaluados por una máquina. El sistema de proctoring con IA, al ser menos invasivo y más automatizado, reduce las interacciones innecesarias y elimina la posibilidad de errores humanos por desconocimiento del contexto del usuario (por ejemplo, una persona con un tic nervioso puede ser malinterpretada por un supervisor humano, pero un sistema de IA puede aprender a ignorar esos patrones si se ajusta adecuadamente). Ahora bien, es importante destacar que los sistemas de proctoring basados en IA no son infalibles ni moralmente neutros. A pesar de sus múltiples ventajas técnicas, requieren una implementación ética y regulada, con políticas claras sobre privacidad, consentimiento, protección de datos y mecanismos de apelación en caso de errores o falsos positivos. En contraste, el proctoring tradicional, al depender de seres humanos, permite una interpretación inmediata del contexto y cierto grado de empatía, lo cual puede ser crucial en evaluaciones delicadas o de alto impacto. Otro diferencial importante es el coste a largo plazo. Aunque el proctoring con IA puede tener una inversión inicial más elevada debido a licencias, infraestructura tecnológica y adecuaciones de seguridad, resulta más eficiente en el tiempo. Una vez implementado, su capacidad para operar a gran escala sin fatiga, con análisis predictivo y métricas integradas, le permite reducir significativamente los costos de gestión de exámenes, especialmente en empresas que ejecutan procesos formativos continuos o dispersos geográficamente.

¿Cómo mejorar la aceptación del proctoring con IA en entornos de formación ejecutiva?

El éxito de cualquier tecnología, especialmente en entornos corporativos, no depende únicamente de su sofisticación técnica, sino de su nivel de aceptación y adopción por parte de los usuarios. En el caso del proctoring con inteligencia artificial (IA), esto es particularmente relevante cuando se implementa en entornos de formación ejecutiva, donde los participantes suelen tener altas expectativas de autonomía, privacidad, experiencia personalizada y respeto por su estatus profesional. Mejorar la aceptación del proctoring IA en este contexto implica abordar no solo aspectos técnicos, sino también emocionales, comunicacionales, éticos y culturales. Uno de los primeros pasos estratégicos es comunicar con transparencia el propósito y funcionamiento del sistema. Los ejecutivos no aceptan fácilmente ser vigilados sin entender el porqué. Debe quedar claro que el objetivo del proctoring IA no es espiar, sino garantizar estándares de calidad, equidad y confiabilidad en los procesos formativos, especialmente en certificaciones críticas que pueden impactar en decisiones de negocio. Comunicar esto con claridad, mediante webinars, documentos explicativos y sesiones informativas, es vital para disipar temores y generar confianza. Además, es necesario explicar cómo funciona la tecnología, qué datos recopila, con qué propósito y cómo se protege la privacidad. Muchos profesionales de nivel gerencial pueden ser escépticos ante sistemas de vigilancia automatizados, especialmente si sienten que invaden su espacio personal. Por tanto, proveer documentación técnica, políticas de privacidad y ejemplos concretos de protección de datos ayudará a reducir la percepción de riesgo. La transparencia técnica y legal es una condición indispensable para fomentar la aceptación consciente y voluntaria. Otro componente crucial es el principio de respeto a la autonomía profesional. A diferencia de otros grupos de empleados, los ejecutivos valoran su independencia en la toma de decisiones y en la manera de gestionar su tiempo. Por ello, es recomendable que la implementación del proctoring IA en este segmento incluya cierto grado de flexibilidad: por ejemplo, permitiendo elegir franjas horarias para rendir evaluaciones, utilizar entornos de confianza o contar con opciones de validación secundaria (verificación posterior de incidentes por un equipo humano). Este enfoque híbrido, que combina tecnología con supervisión personalizada, suele tener mayor aceptación entre líderes empresariales. El diseño de la experiencia también es fundamental. El proctoring con IA debe integrarse de manera fluida en la plataforma de formación, sin generar fricciones tecnológicas, interfaces confusas o interrupciones innecesarias. En entornos ejecutivos, el tiempo es un recurso escaso y altamente valorado, por lo que cualquier demora, fallo técnico o requerimiento poco claro puede generar frustración y rechazo. Por tanto, la interfaz debe ser amigable, eficiente y profesional, con soporte técnico en tiempo real para resolver cualquier inconveniente. Desde el punto de vista cultural, es recomendable alinear el uso del proctoring IA con los valores corporativos de la empresa. Si la organización promueve la innovación, la transformación digital y la toma de decisiones basadas en datos, entonces esta herramienta puede posicionarse como una extensión natural de esa filosofía. En cambio, si la cultura organizacional está más orientada a la confianza, la colaboración y el empowerment, será importante destacar que el uso de IA no reemplaza la confianza en las personas, sino que garantiza justicia y uniformidad en los procesos de evaluación. Otra estrategia poderosa es involucrar a los ejecutivos en el diseño y evaluación del sistema antes de su implementación masiva. Esto puede hacerse mediante pilotos, focus groups o pruebas controladas donde los líderes puedan experimentar la tecnología, brindar feedback y sentir que su opinión influye en la toma de decisiones. Esta co-creación genera apropiación, reduce resistencias y mejora la percepción de legitimidad del sistema. También es clave implementar un sistema de soporte post-evaluación, que permita revisar alertas generadas por la IA, ofrecer canales de apelación y demostrar que el proceso incluye una capa de interpretación humana cuando sea necesario. Saber que no están a merced exclusiva de un algoritmo tranquiliza a muchos usuarios y fortalece la sensación de equidad y control. Por último, se recomienda medir periódicamente la percepción de los usuarios sobre el sistema. Encuestas de satisfacción, entrevistas cualitativas o indicadores de participación pueden ofrecer información valiosa para ajustar el sistema, mejorar la comunicación o adaptar las políticas de uso. Escuchar a los usuarios, especialmente en niveles ejecutivos, no solo mejora la aceptación, sino que fortalece el vínculo entre tecnología y experiencia de aprendizaje.

¿Puede la IA ofrecer feedback inmediato tras una evaluación?

La inteligencia artificial (IA) está revolucionando todos los aspectos del eLearning corporativo, desde la personalización de contenidos hasta la automatización de evaluaciones. Uno de los avances más significativos, especialmente desde la perspectiva del rendimiento y la agilidad organizacional, es la capacidad de ofrecer feedback inmediato al finalizar una evaluación. En entornos empresariales, donde el tiempo es un recurso crítico y la velocidad de aprendizaje impacta directamente en la ejecución de proyectos, esta funcionalidad puede marcar una diferencia sustancial. Sin embargo, es necesario entender tanto el alcance actual de esta capacidad como sus implicancias estratégicas. La IA, a través de algoritmos de procesamiento de lenguaje natural, machine learning y análisis predictivo, puede analizar en tiempo real las respuestas de un colaborador, evaluar patrones, identificar errores comunes y generar comentarios personalizados apenas finaliza la prueba. Esta respuesta automática e inmediata representa un cambio de paradigma frente a los modelos tradicionales donde el feedback podía tardar horas o días, dependiendo de la disponibilidad de un evaluador humano. Para los líderes de talento, esto significa la posibilidad de acelerar los ciclos de aprendizaje, detectar brechas de conocimiento en tiempo real y tomar decisiones formativas más oportunas. Una de las principales ventajas del feedback inmediato basado en IA es la personalización. No se trata de comentarios genéricos como “respuesta correcta” o “respuesta incorrecta”, sino de análisis detallados que pueden incluir explicaciones conceptuales, sugerencias de recursos adicionales, referencias cruzadas con contenidos previos y recomendaciones de mejora. Este nivel de profundidad permite que el colaborador no solo sepa si acertó o no, sino por qué lo hizo y cómo puede mejorar. En una cultura organizacional centrada en el desarrollo continuo, esta herramienta se convierte en una palanca poderosa para empoderar al empleado. Desde la perspectiva del negocio, el feedback inmediato también contribuye a mejorar la eficiencia operativa. Los responsables de formación ya no necesitan destinar tiempo valioso a revisar pruebas, emitir reportes o responder preguntas repetitivas. La IA asume esa función de forma escalable y sistemática, liberando recursos para tareas de mayor valor estratégico. Además, al estar integrada con sistemas LMS (Learning Management Systems), la retroalimentación se almacena, se analiza a nivel colectivo y puede integrarse en dashboards ejecutivos para monitorear el progreso del talento organizacional. Otro aspecto relevante es el impacto psicológico positivo que genera en el evaluado. Recibir una devolución inmediata, clara y orientada al crecimiento crea una sensación de justicia y respeto. El colaborador siente que su esfuerzo es reconocido en el momento, lo que incrementa la motivación, la confianza y el compromiso con el proceso formativo. Además, este tipo de retroalimentación facilita el aprendizaje activo y autónomo: al conocer sus errores de inmediato, el usuario puede corregir, explorar nuevas fuentes y reforzar su conocimiento de forma autónoma, sin depender de un formador externo. Ahora bien, es importante matizar estas ventajas con una mirada crítica sobre las capacidades reales de la IA en términos de feedback. La eficacia del sistema depende en gran medida del tipo de contenido evaluado. En pruebas de opción múltiple, emparejamiento, selección o verdadero/falso, la IA puede brindar retroalimentación casi perfecta, porque los resultados son objetivos y fáciles de interpretar. Pero en evaluaciones abiertas, donde se requiere análisis crítico, redacción o resolución de problemas complejos, el feedback automático puede ser más limitado o susceptible a errores de interpretación. Aun así, los avances en procesamiento de lenguaje natural (NLP) han permitido que modelos de IA más sofisticados ofrezcan comentarios coherentes incluso sobre textos extensos, siempre que hayan sido entrenados adecuadamente. Otro factor clave a considerar es la calidad del entrenamiento del modelo de IA. Si se utiliza un motor genérico, la retroalimentación puede ser vaga o poco contextualizada. Por ello, las organizaciones que desean implementar esta funcionalidad deben invertir en la configuración del sistema, asegurándose de que los modelos estén entrenados con contenido relevante para su sector, nivel jerárquico y cultura organizacional. La adaptación del lenguaje, el tono y el tipo de sugerencias a los perfiles de los colaboradores es lo que permite convertir una IA funcional en una IA verdaderamente estratégica. Además, el feedback inmediato puede convertirse en una herramienta de diagnóstico organizacional. Al analizar de forma agregada los errores comunes, las dudas frecuentes y las áreas de menor rendimiento, los líderes pueden detectar fallas estructurales en sus programas de formación, brechas de conocimiento por departamentos o equipos, e incluso áreas de oportunidad para mejorar procesos de negocio. Este enfoque convierte el feedback no solo en un mecanismo de mejora individual, sino en una fuente de inteligencia colectiva para la toma de decisiones de alto nivel. No obstante, también existen desafíos. El feedback automático debe ser cuidadosamente diseñado para no parecer deshumanizado, frío o punitivo. En el contexto de una formación ejecutiva, por ejemplo, un comentario mal redactado puede generar incomodidad o incluso rechazo. Por eso es recomendable combinar el feedback automatizado con instancias de acompañamiento humano, especialmente cuando se trata de evaluaciones complejas o temas sensibles. Además, es importante permitir que los usuarios den retroalimentación sobre la IA misma, con el fin de mejorar continuamente la calidad del servicio. Finalmente, es vital considerar aspectos de ética y transparencia. Los colaboradores deben saber que están recibiendo feedback generado por una máquina, comprender cómo se genera, qué datos se usan y qué márgenes de error pueden existir. Ocultar esta información puede generar desconfianza o sensación de manipulación, mientras que explicitarla refuerza una cultura organizacional basada en la honestidad, la tecnología responsable y la colaboración hombre-máquina.

¿Qué riesgos de privacidad surgen al utilizar IA en exámenes remotos?

El uso de inteligencia artificial en exámenes remotos, especialmente a través de sistemas de proctoring, representa una innovación sin precedentes en el ámbito del eLearning corporativo. No obstante, esta misma innovación viene acompañada de un conjunto de riesgos relacionados con la privacidad de los colaboradores que deben ser abordados de manera rigurosa por los responsables de recursos humanos, legales y tecnológicos. En una era donde la confianza digital es tan importante como la eficiencia operativa, comprender y mitigar estos riesgos se convierte en una prioridad estratégica. Uno de los riesgos más evidentes es la captura excesiva de datos personales. Los sistemas de proctoring con IA suelen requerir acceso a la cámara web, el micrófono, el historial del navegador, las pulsaciones del teclado y otros indicadores biométricos o conductuales. Si bien estas herramientas permiten detectar comportamientos sospechosos y asegurar la integridad del examen, también recogen información que puede considerarse intrusiva, especialmente cuando los colaboradores están siendo evaluados desde sus propios hogares. La captura de imágenes del entorno personal, conversaciones de fondo o incluso de otras personas presentes representa una invasión potencial a la esfera privada del individuo. A esto se suma el riesgo de almacenamiento inseguro o mal gestionado de datos sensibles. Los sistemas de proctoring no solo recopilan datos en tiempo real, sino que suelen almacenar grabaciones, logs y métricas asociadas a cada usuario. Si estos datos no están cifrados adecuadamente, se almacenan en servidores de baja seguridad o se transfieren entre plataformas sin las debidas precauciones, pueden estar expuestos a vulneraciones, filtraciones o usos indebidos. Esto no solo pondría en riesgo la información personal del colaborador, sino que también podría generar consecuencias legales y reputacionales graves para la empresa. Otro riesgo relevante es la falta de transparencia sobre el uso de los datos. En muchos casos, los colaboradores no tienen claridad sobre qué información se está recopilando, con qué propósito, quién tiene acceso a ella y durante cuánto tiempo se conservará. Esta opacidad puede generar una sensación de vigilancia encubierta, deteriorar la confianza organizacional y dar pie a conflictos con los sindicatos o los comités internos de ética. Por ello, la implementación de proctoring con IA debe ir acompañada de políticas de privacidad claras, comprensibles y accesibles, además de procesos de consentimiento informado genuino. El uso de IA también abre la puerta al riesgo de decisiones automatizadas sin intervención humana, lo cual puede resultar problemático en evaluaciones importantes. Por ejemplo, si un sistema detecta una “anomalía” en el comportamiento del colaborador (como mirar fuera de la pantalla durante varios segundos o escuchar un ruido de fondo), podría generar una alerta automática que impacte su evaluación sin tener en cuenta el contexto real. Esta automatización puede producir falsos positivos y afectar la carrera profesional del empleado, especialmente si no existen canales claros para apelar o revisar las decisiones del sistema. Otro aspecto delicado es la posibilidad de discriminación o sesgo algorítmico. Algunos sistemas de reconocimiento facial pueden tener dificultades para identificar rostros de personas con determinados rasgos étnicos o con discapacidades físicas. Esto no solo afecta la calidad de la supervisión, sino que también puede interpretarse como una forma de exclusión tecnológica. Las organizaciones que no auditan sus sistemas regularmente y que no garantizan la equidad de los algoritmos están exponiéndose a situaciones éticamente reprobables y legalmente cuestionables. Además, debemos considerar el riesgo de exposición legal frente a normativas de protección de datos, como el Reglamento General de Protección de Datos (RGPD) en Europa, la Ley de Protección de Datos Personales en Latinoamérica o la CCPA en California. Estas legislaciones imponen fuertes restricciones sobre la recolección y tratamiento de datos personales, especialmente en entornos laborales. Si una empresa utiliza un proveedor de proctoring que no cumple con estas normativas, podría enfrentar sanciones económicas, demandas colectivas o bloqueos regulatorios. En el plano interno, el uso de IA para vigilancia puede generar un clima de desconfianza entre los colaboradores, especialmente si se percibe que la organización prioriza el control por sobre la colaboración. Esta desconfianza puede erosionar el compromiso, reducir la participación en procesos formativos y obstaculizar la adopción de otras tecnologías. Para evitar esto, es fundamental que los líderes comuniquen de forma empática y clara el propósito del sistema, sus límites y las garantías existentes para proteger la privacidad de los usuarios.

¿Cuál es el retorno sobre la inversión (ROI) del eLearning con proctoring IA?

Medir el retorno sobre la inversión (ROI) de iniciativas de eLearning es, desde hace años, uno de los desafíos más importantes en la gestión del talento organizacional. Cuando a esto se le suma la incorporación de tecnologías avanzadas como el proctoring con inteligencia artificial (IA), la necesidad de demostrar resultados tangibles se vuelve aún más relevante para justificar presupuestos, sostener la adopción tecnológica y vincular las inversiones en aprendizaje con los objetivos estratégicos del negocio. El ROI del eLearning con proctoring IA no solo debe medirse en términos de ahorro de costos, sino también en eficiencia operativa, reducción de riesgos, escalabilidad, calidad de resultados y percepción de valor entre los colaboradores. Para comenzar, debemos entender que el ROI se calcula, de forma básica, como la relación entre los beneficios obtenidos por una inversión y el costo de dicha inversión. En el caso del eLearning con proctoring IA, los beneficios van mucho más allá de los financieros directos. Una evaluación completa debe considerar tanto los beneficios cuantitativos como los cualitativos. Entre los primeros podemos identificar la reducción de horas hombre para supervisión de exámenes, disminución de errores humanos, optimización del tiempo de respuesta y ahorro logístico. Entre los segundos, encontramos el aumento de la confiabilidad de las evaluaciones, la mejora en la experiencia del usuario, el incremento del cumplimiento regulatorio y la generación de datos accionables para la toma de decisiones. Uno de los beneficios más inmediatos y tangibles del proctoring IA es la reducción de costos operativos. En los modelos tradicionales, cada examen requiere la presencia de supervisores humanos, ya sea de forma presencial o remota, lo que implica costos en horas de trabajo, formación, coordinación logística, infraestructura física o digital, y soporte técnico. Al automatizar la supervisión mediante IA, estos costos se reducen drásticamente. Un sistema bien implementado puede monitorear cientos o miles de exámenes de forma simultánea sin intervención humana directa, lo que representa una disminución significativa en los costos de ejecución por unidad de evaluación. Además, el eLearning con proctoring IA aumenta la escalabilidad de los programas formativos. Antes, si una empresa quería certificar a 1000 colaboradores distribuidos en distintas regiones, debía organizar múltiples sesiones, con distintos horarios, supervisores y recursos. Con la IA, esto puede hacerse en un solo día, de forma asincrónica, sin necesidad de ajustar horarios ni contratar supervisores adicionales. Esta capacidad de escalar sin incrementar proporcionalmente los recursos utilizados se traduce en una mayor eficiencia del gasto formativo y, por lo tanto, en un ROI más alto. Otro factor relevante es la disminución del riesgo de fraude o suplantación de identidad. En entornos corporativos, especialmente cuando las evaluaciones se relacionan con cumplimiento normativo, seguridad, acreditaciones técnicas o procesos de certificación internos, cualquier fraude puede generar consecuencias severas: desde fallos operativos hasta sanciones legales. El proctoring IA permite detectar en tiempo real comportamientos sospechosos, como desvío de mirada, presencia de múltiples voces, cambios de pantalla no autorizados o patrones de comportamiento atípico, lo que reduce significativamente estos riesgos. La mitigación de estos riesgos es, en sí misma, un retorno valioso para la organización, ya que evita pérdidas financieras, sanciones regulatorias y daños reputacionales. Desde un enfoque de capital humano, el ROI también se refleja en la mejora de la experiencia del colaborador. Recibir feedback inmediato, tener procesos formativos accesibles, no depender de supervisores humanos y poder certificar sus conocimientos desde cualquier lugar, son beneficios que fortalecen el compromiso y la percepción de valor del aprendizaje corporativo. Esto tiene un impacto directo en la retención del talento, la motivación y la alineación con los valores de innovación de la empresa. En un contexto donde la experiencia del empleado se convierte en un diferenciador competitivo, estos intangibles tienen un peso cada vez mayor en la ecuación de retorno de inversión. El eLearning con proctoring IA también permite una toma de decisiones más inteligente basada en datos reales. Cada evaluación genera un conjunto de datos que puede analizarse para identificar patrones, brechas de conocimiento, áreas críticas y oportunidades de mejora. Esta analítica formativa permite ajustar los programas en tiempo real, focalizar inversiones donde más se necesitan y anticiparse a necesidades futuras. La posibilidad de convertir la evaluación en una fuente de inteligencia estratégica multiplica el valor de cada dólar invertido y refuerza el impacto del aprendizaje sobre los objetivos de negocio. Por supuesto, para calcular el ROI real es necesario también considerar los costos de implementación. Estos incluyen licencias de software, integración con LMS, capacitación de los equipos internos, adecuación de políticas de privacidad y soporte técnico. Si bien estos costos pueden parecer elevados inicialmente, su retorno suele producirse en plazos más cortos de lo esperado. Según estudios realizados por organizaciones como Deloitte o Brandon Hall Group, las empresas que invierten en automatización de la formación logran recuperar su inversión en menos de 12 meses, siempre que el sistema se alinee correctamente con las metas corporativas. Adicionalmente, el uso de IA en procesos de evaluación contribuye a estandarizar y elevar el nivel de exigencia académica en los programas internos. Esto se traduce en mejores resultados de aprendizaje, mayor calidad en el desempeño posterior y una cultura organizacional más orientada a la excelencia. Estos impactos, aunque difíciles de cuantificar de inmediato, terminan por influir positivamente en los indicadores clave del negocio: productividad, innovación, calidad del servicio y satisfacción del cliente interno. Un aspecto poco mencionado pero importante es el efecto de marca empleadora. Las organizaciones que adoptan tecnologías como el proctoring IA y las comunican como parte de su propuesta de valor al talento proyectan una imagen de modernidad, rigurosidad y compromiso con el desarrollo profesional. Esta percepción incide directamente en la atracción de talento, especialmente entre perfiles jóvenes o altamente digitales que valoran la innovación en el entorno laboral.

¿Qué estrategias usar para hacer del proctoring IA una herramienta de mejora continua?

Uno de los errores más comunes en la implementación de tecnologías corporativas es tratarlas como soluciones estáticas, cuando en realidad deben entenderse como sistemas dinámicos que evolucionan, aprenden y se optimizan con el tiempo. Esto aplica especialmente al proctoring con inteligencia artificial (IA), que más allá de ser una herramienta de vigilancia o supervisión, puede convertirse en una fuente poderosa de mejora continua para los procesos de formación, evaluación y desarrollo organizacional. Para lograr que el proctoring IA se convierta en una herramienta de mejora continua, es necesario primero transformar el propósito con el que se implementa. Si esta tecnología se percibe exclusivamente como un mecanismo de control o prevención del fraude, su impacto será limitado y posiblemente resistido. En cambio, si se posiciona como una herramienta para mejorar la calidad del aprendizaje, refinar los contenidos formativos, personalizar la experiencia del usuario y elevar la credibilidad de las evaluaciones, el enfoque cambia radicalmente. Es un cambio de narrativa: del control a la evolución. Una de las estrategias clave es analizar y aprovechar los datos generados por el sistema. Cada evaluación supervisada por IA produce un conjunto de métricas valiosas: patrones de comportamiento, tasas de finalización, tiempos de respuesta, incidentes detectados, errores frecuentes, zonas de duda o inseguridad, etc. Estas métricas no deben quedarse en reportes técnicos; deben ser integradas a los procesos de revisión pedagógica, rediseño curricular y toma de decisiones. El equipo de formación debe trabajar codo a codo con los analistas de datos para traducir estos insumos en mejoras concretas. Una segunda estrategia efectiva es ajustar y entrenar constantemente los algoritmos del sistema. A diferencia de un software tradicional, los modelos de IA aprenden. Esto significa que si se alimentan con datos de calidad, retroalimentación humana y casos bien categorizados, su capacidad de detección y análisis mejora con el tiempo. Por eso, es fundamental establecer un proceso de validación constante de las alertas, revisión de falsos positivos y ajuste de los parámetros de supervisión. La IA debe “entender” cada vez mejor el contexto específico de la empresa, su cultura, sus usuarios y sus objetivos formativos. Además, se debe fomentar una cultura de aprendizaje organizacional alrededor del proctoring IA. Esto implica formar a los colaboradores para que comprendan cómo funciona la herramienta, cómo interpretar su feedback y cómo usarla para mejorar sus propios procesos de estudio o certificación. La IA no debe ser un sistema que “castiga” conductas, sino una interfaz que guía, enseña y promueve el desarrollo profesional. Cuando los usuarios entienden que pueden aprender incluso de las alertas o los reportes generados, se apropian del proceso y lo convierten en parte de su crecimiento. Otra estrategia vital es incluir mecanismos de revisión humana y mejora pedagógica. No todo lo que la IA detecta es necesariamente un problema. Es importante contar con comités o equipos de revisión que analicen los reportes del sistema y determinen si hay patrones preocupantes, fallas de diseño en los exámenes, contenidos mal formulados o condiciones tecnológicas que están afectando el rendimiento. Esta combinación de supervisión automatizada y análisis humano es lo que realmente convierte al proctoring IA en una herramienta de mejora continua. El feedback sistemático y bidireccional es otra piedra angular. El sistema debe no solo generar feedback hacia el usuario, sino también recibirlo. Las plataformas de proctoring IA más avanzadas permiten que los usuarios califiquen la experiencia, reporten fallos, sugieran mejoras y comenten sobre la utilidad de los reportes recibidos. Esta información debe ser procesada por los responsables del sistema para ajustar funcionalidades, mejorar la experiencia y adaptar el sistema a las expectativas de los colaboradores. Por último, se recomienda alinear el uso del proctoring IA con los ciclos de mejora de la empresa, como las auditorías internas, revisiones semestrales de desempeño o los KPIs de aprendizaje. Cuando esta tecnología se inserta dentro del sistema de calidad de la organización, deja de ser un accesorio técnico para convertirse en un pilar del aprendizaje estratégico. Además, puede integrarse con otras herramientas como dashboards, sistemas de BI o plataformas de talento para dar una visión completa del ciclo de aprendizaje del empleado.

¿Qué rol cumple el procesamiento de lenguaje natural (PLN) en estas soluciones?

El procesamiento de lenguaje natural (PLN), conocido en inglés como Natural Language Processing (NLP), es una subdisciplina de la inteligencia artificial que permite a las máquinas comprender, interpretar, generar y responder en lenguaje humano. En el contexto del proctoring con IA, esta tecnología cumple un rol cada vez más estratégico, aportando capacidades que van mucho más allá de la mera vigilancia visual. El PLN permite una supervisión más profunda, contextualizada y flexible, transformando el sistema en una herramienta inteligente que no solo observa lo que ocurre durante un examen, sino que también comprende lo que se dice, se escribe y se comunica. Para los líderes empresariales que buscan implementar sistemas avanzados de evaluación y formación, comprender el alcance del PLN dentro de estas soluciones es fundamental. Este componente no es un accesorio opcional, sino un habilitador clave de funcionalidades que elevan el valor del proctoring más allá del control. Uno de los usos más evidentes del PLN en el proctoring es la detección de habla sospechosa durante una evaluación. Muchos sistemas avanzados están equipados con reconocimiento de voz que, apoyado por modelos de PLN, puede identificar si un candidato está recibiendo ayuda verbal, leyendo en voz alta o interactuando con otra persona durante un examen. Este análisis no se limita a la detección de sonido, sino que puede evaluar el contenido lingüístico para determinar si las palabras pronunciadas tienen relación con la prueba, lo cual representa una clara señal de comportamiento irregular. Esta capacidad requiere que el sistema no solo escuche, sino que comprenda el lenguaje en contexto. Además, el PLN también se utiliza para evaluar automáticamente las respuestas escritas en preguntas abiertas. A diferencia de las preguntas de opción múltiple, las evaluaciones que implican redacción requieren una interpretación semántica para valorar el contenido, la lógica del argumento, la estructura gramatical y la coherencia con los objetivos de aprendizaje. Aquí es donde el PLN cobra protagonismo, ya que permite a los sistemas de proctoring con IA no solo identificar si un texto fue copiado (mediante técnicas de detección de plagio), sino también analizar su contenido para dar un feedback inmediato al evaluado o generar alertas si detecta respuestas poco coherentes, contradictorias o genéricas. En este sentido, el PLN actúa como un evaluador automatizado, ofreciendo beneficios tanto para los formadores como para los colaboradores. Desde el punto de vista operativo, se reduce la carga de corrección manual, se acelera la retroalimentación y se incrementa la equidad del proceso al aplicar los mismos criterios a todos los evaluados. Desde el punto de vista del colaborador, se recibe un análisis más detallado y útil que permite mejorar la comprensión del tema, reforzar el aprendizaje y avanzar con mayor autonomía. Otro rol fundamental del PLN es en la comprensión contextual de comportamientos verbales o escritos. Por ejemplo, si un evaluado consulta al sistema de soporte mediante un chat, el motor de PLN puede interpretar sus preguntas y ofrecer respuestas pertinentes en tiempo real. Este tipo de asistentes inteligentes integrados en las plataformas de evaluación mejoran la experiencia del usuario y reducen la carga del equipo de soporte humano. Incluso pueden anticipar problemas o frustraciones del usuario a partir del tono emocional del mensaje, permitiendo intervenciones proactivas por parte del equipo de formación o tecnología. Asimismo, los modelos de PLN pueden ser entrenados para identificar patrones de lenguaje asociados con fraude o suplantación. Por ejemplo, frases como “¿cuál es la respuesta de la dos?” pronunciadas en voz baja pueden activar una alerta inmediata. Incluso, al combinar PLN con análisis emocional, se puede detectar si una persona está bajo un nivel de estrés anormal, lo cual puede indicar condiciones atípicas durante la evaluación. Este tipo de análisis contextual solo es posible gracias a la capacidad del PLN de entender el lenguaje como fenómeno humano, más allá de su literalidad. En un plano más estratégico, el PLN también puede ser utilizado para minar información desde las evaluaciones, convirtiendo respuestas cualitativas en insumos para la toma de decisiones. Por ejemplo, en una evaluación de clima organizacional o cultura ética, los sistemas pueden interpretar las narrativas escritas por los colaboradores, agruparlas temáticamente y detectar tendencias o preocupaciones emergentes. De este modo, la empresa transforma las evaluaciones en una fuente rica de inteligencia organizacional. Desde una perspectiva técnica, la incorporación del PLN dentro del proctoring exige ciertas condiciones: bases de datos lingüísticas robustas, capacidad de entrenamiento supervisado, procesamiento semántico multilingüe (en especial para organizaciones globales), y un diseño ético y responsable que evite el sesgo algorítmico. Aquí, el rol de los equipos de tecnología y compliance es clave: deben asegurarse de que los motores de PLN respeten los principios de privacidad, consentimiento y no discriminación. En términos de futuro, el PLN abre las puertas a formas mucho más sofisticadas de supervisión y aprendizaje personalizado. Por ejemplo, en lugar de castigar automáticamente a un usuario que comete un error, el sistema podría interpretar el tipo de error, clasificarlo según nivel de comprensión y ofrecer recursos formativos específicos en el mismo momento. Esto representa una evolución del proctoring como mecanismo punitivo hacia un modelo de acompañamiento inteligente.

¿Cómo se puede integrar el proctoring IA con plataformas LMS ya existentes?

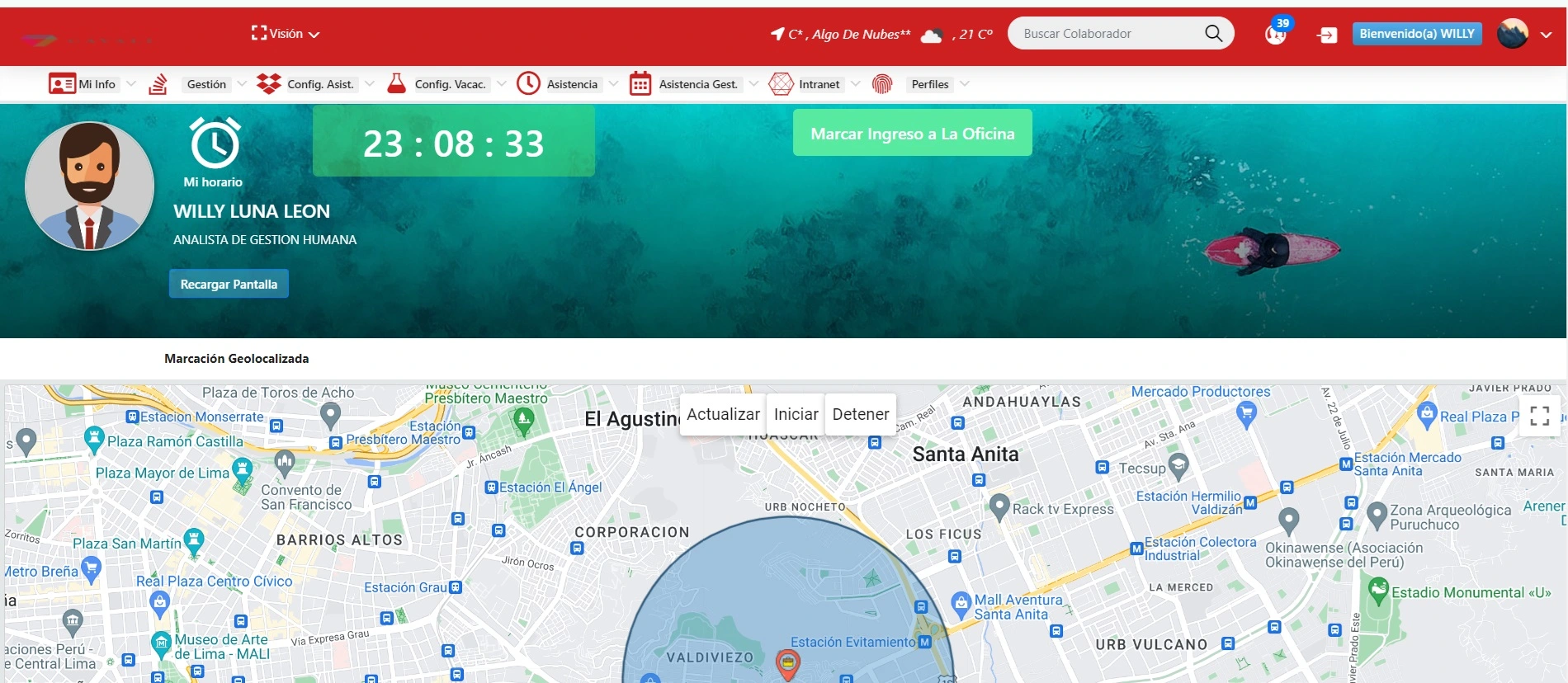

La integración del proctoring basado en inteligencia artificial (IA) con los sistemas de gestión del aprendizaje (LMS, por sus siglas en inglés) ya existentes representa uno de los mayores desafíos —y oportunidades— para las organizaciones que buscan transformar digitalmente sus procesos formativos. Mientras que el LMS se encarga de administrar, distribuir y rastrear programas de formación, el proctoring IA se enfoca en asegurar la integridad de las evaluaciones dentro de ese proceso. La fusión de ambas plataformas no solo garantiza una operación más eficiente, sino que permite consolidar un ecosistema de aprendizaje automatizado, seguro, transparente y alineado con los objetivos estratégicos de la empresa. La integración exitosa entre el LMS y el proctoring IA debe comenzar por un diagnóstico técnico y funcional del sistema actual. Las organizaciones suelen utilizar plataformas como Moodle, Blackboard, TalentLMS, SAP SuccessFactors, Docebo, Cornerstone o plataformas desarrolladas a medida. Cada LMS tiene su propia arquitectura, nivel de apertura y políticas de seguridad. Antes de implementar cualquier sistema de proctoring, es fundamental analizar si el LMS permite integraciones a través de API, LTI (Learning Tools Interoperability), SSO (Single Sign-On) o webhooks. Estas son las puertas de entrada necesarias para que ambos sistemas puedan comunicarse sin fricciones. El segundo paso estratégico es seleccionar un proveedor de proctoring que sea compatible con el LMS en uso. Existen múltiples soluciones en el mercado —como ProctorU, Honorlock, Respondus, Examity, entre otros— que ofrecen distintos niveles de integración con plataformas educativas y corporativas. La clave está en elegir un proveedor que cuente con experiencia en integraciones con LMS similares al de la empresa, y que ofrezca soporte técnico para adaptar la solución a necesidades específicas. La compatibilidad debe ser técnica, pero también funcional: la experiencia del usuario no debe verse afectada negativamente por una integración torpe o fragmentada. Una vez definida la viabilidad técnica y seleccionado el proveedor, el tercer paso es diseñar la arquitectura de integración. Esto implica establecer cómo y cuándo se activará el sistema de proctoring dentro del flujo formativo. Por ejemplo, ¿se activará automáticamente al comenzar un examen? ¿El colaborador deberá autorizar el uso de la cámara y micrófono antes de iniciar? ¿Qué datos se transferirán del LMS al sistema de proctoring (nombre, ID del usuario, curso, módulo, etc.) y cuáles se devolverán (resultados, incidentes, grabaciones)? Este diseño debe estar enfocado en la simplicidad, la seguridad y la experiencia del usuario. Un aspecto crítico en este punto es la sincronización de datos y resultados. Es fundamental que los reportes generados por el proctoring IA se reflejen automáticamente dentro del LMS para que los formadores, responsables de talento humano y usuarios puedan consultar los resultados sin necesidad de cambiar de plataforma. Esto implica definir qué tipo de datos se transferirán (porcentaje de sospechas, alertas, videos, estadísticas, etc.) y cómo se visualizarán. La automatización de este flujo de datos convierte al LMS en un verdadero centro de comando del aprendizaje, permitiendo una gestión integral del ciclo formativo. En paralelo, se deben considerar aspectos de seguridad y cumplimiento normativo. Toda integración debe respetar las políticas de privacidad de datos, garantizar el consentimiento informado de los usuarios y cumplir con normativas como el RGPD o la Ley de Protección de Datos local. Esto implica que la arquitectura de integración debe incluir protocolos de cifrado, validación de identidad y almacenamiento seguro. En muchas organizaciones, este aspecto requiere la aprobación previa de los equipos legales, de compliance y ciberseguridad. Desde el punto de vista del usuario, la integración debe ser lo más transparente y fluida posible. Idealmente, el colaborador no debería tener que iniciar sesión en dos sistemas distintos, ni realizar configuraciones técnicas para poder acceder a su evaluación. Aquí entra en juego la implementación de SSO, que permite que el acceso al proctoring se realice automáticamente desde el LMS. Asimismo, las interfaces deben estar unificadas o, al menos, estéticamente coherentes, para no generar confusión o desconfianza durante la evaluación. Una buena práctica complementaria es probar la integración en entornos piloto antes de hacer un despliegue masivo. Esto permite detectar incompatibilidades, errores de sincronización, problemas de usabilidad o fallas en la seguridad. Involucrar a usuarios finales en estas pruebas también permite recoger feedback temprano y realizar ajustes necesarios antes del lanzamiento oficial. Por último, integrar el proctoring con el LMS no debe ser un proyecto aislado, sino parte de una estrategia de transformación digital del aprendizaje. Esto implica que la integración debe alinearse con indicadores clave de desempeño (KPI), planes de formación por competencias, rutas de aprendizaje personalizadas y objetivos organizacionales. Cuando se gestiona como parte de una visión sistémica, esta integración deja de ser un simple puente técnico y se convierte en una plataforma estratégica para el desarrollo del talento, la gestión del conocimiento y la competitividad del negocio. 🧾 Resumen Ejecutivo La transformación digital en la formación corporativa ya no es una tendencia, sino una necesidad estructural para organizaciones que buscan agilidad, escalabilidad y control de calidad en el desarrollo de su capital humano. En este contexto, el proctoring con inteligencia artificial (IA) se ha posicionado como una herramienta clave para garantizar la integridad y eficacia de los procesos evaluativos en entornos de eLearning. Este artículo ha explorado con profundidad diez dimensiones críticas que rodean la implementación de estas soluciones. A continuación, se resumen las principales conclusiones, destacando su valor estratégico para WORKI 360, como plataforma de gestión de talento y formación. 1. Impacto organizacional positivo y transformador El proctoring IA puede fortalecer la cultura organizacional cuando se comunica y gestiona estratégicamente. Más allá de una herramienta de vigilancia, se convierte en un símbolo de meritocracia, transparencia, equidad y compromiso con el aprendizaje de calidad. Para WORKI 360, esto representa una oportunidad de posicionar su oferta como catalizadora de culturas empresariales orientadas al alto desempeño. 2. Gestión ética como ventaja competitiva El análisis revela que el uso de IA en evaluaciones remotas plantea importantes desafíos éticos relacionados con privacidad, consentimiento, sesgo algorítmico y autonomía profesional. WORKI 360 puede diferenciarse al ofrecer soluciones de proctoring con gobernanza ética incorporada, cumpliendo estándares internacionales de privacidad (como el RGPD) y generando confianza desde el diseño. 3. Diferenciación tecnológica frente a sistemas tradicionales La comparación entre el proctoring tradicional y el impulsado por IA es clara: la IA ofrece mayor escalabilidad, precisión, objetividad y capacidad de análisis. WORKI 360 puede aprovechar esta diferencia para ofrecer a sus clientes un salto cualitativo en control de calidad formativo, reduciendo drásticamente los costos operativos asociados a la supervisión manual. 4. Estrategias para adopción exitosa en niveles ejecutivos La aceptación por parte de usuarios de nivel gerencial es clave para el éxito. El artículo ofrece estrategias accionables como transparencia, autonomía, soporte humano, feedback contextualizado y pilotos de prueba. WORKI 360 puede integrarlas como parte de su metodología de implementación, asegurando una transición fluida y aceptada por todos los niveles jerárquicos. 5. Feedback inmediato como motor de aprendizaje ágil Una de las mayores ventajas del proctoring IA es su capacidad de entregar feedback inmediato, personalizado y útil tras cada evaluación. Este elemento transforma la evaluación en una experiencia de aprendizaje, reduce la dependencia de tutores humanos y acelera el cierre de brechas. WORKI 360 puede integrar esta funcionalidad como un valor añadido altamente demandado por empresas orientadas a la mejora continua. 6. Gestión proactiva de riesgos de privacidad Se identifican riesgos significativos si no se aplican políticas de privacidad rigurosas. WORKI 360 tiene la posibilidad de liderar con el ejemplo al ofrecer entornos seguros, transparentes y configurables, donde los datos sean protegidos rigurosamente, generando diferenciación por confianza digital. 7. Retorno de inversión (ROI) claro y multifacético El proctoring IA ofrece un ROI positivo, medido no solo en ahorro operativo, sino también en reducción de fraudes, aceleración de procesos, escalabilidad, calidad de decisiones y mejora de la experiencia del empleado. WORKI 360 puede utilizar este argumento de valor para justificar la inversión frente a comités financieros y gerenciales. 8. Transformación del proctoring en herramienta de mejora continua Lejos de ser un sistema pasivo de vigilancia, el proctoring IA puede convertirse en una fuente de mejora pedagógica, rediseño curricular, personalización del aprendizaje y análisis de desempeño. WORKI 360 puede posicionarse como una plataforma de aprendizaje evolutiva, inteligente y centrada en la mejora constante. 9. Rol estratégico del procesamiento de lenguaje natural (PLN) El PLN permite que el sistema interprete lenguaje humano en tiempo real, evalúe respuestas abiertas, identifique fraudes verbales y ofrezca feedback semántico. Esta capacidad diferencial eleva la sofisticación del sistema y permite a WORKI 360 ofrecer soluciones de proctoring verdaderamente avanzadas, aplicables incluso a evaluaciones cualitativas o ejecutivas. 10. Integración natural con plataformas LMS existentes La interoperabilidad es clave para evitar fricciones tecnológicas. WORKI 360 puede integrarse sin problemas con LMS líderes del mercado, a través de APIs, LTI o SSO, garantizando una experiencia fluida para el usuario final y una administración centralizada para los formadores.